matrix-review-note

矩阵复习笔记

0x00 矩阵基本概念

矩阵初等行变换

直接上例题:

其增广矩阵为:

其简约阶梯型矩阵为:

对应线性方程组为:

最后的通解为:$x_1=\frac{5}{6}-x_2, x_3=\frac{2}{3}$。

符号表示

$\mathbb{R}$表示实数集合,$\mathbb{C}$表示复数集合。

向量空间:以向量为元素的集合,N维向量的集合称为N维空间,例如$\mathcal{R}^N$、$\mathcal{C}^N$。

子空间:W是$\mathcal{R}^N$的一个子空间,需要满足三个条件:加法闭合性、标乘闭合性、$\mathbf{0} \in W$。假设A和B是向量空间的子空间,那么子空间的和为:$\mathbf{A}+\mathbf{B}={\mathbf{x}+\mathbf{y} \mid \mathbf{x} \in \mathbf{A}, \mathbf{y} \in \mathbf{B}}$,子空间的交为:$\mathbf{A} \cap \mathbf{B}={\mathbf{x} \in \mathbf{V} \mid \mathbf{x} \in \mathbf{A}, \mathbf{x} \in \mathbf{B}}$。交与和也是子空间。

转置矩阵:$A^T$;共轭矩阵:$A^*$;共轭转置矩阵:$A^H$;Hermitian矩阵:$\mathbf{A}^H=\mathbf{A}$;幂等矩阵:$\mathbf{A}^2=\mathbf{A}$。

函数向量:向量的元素是函数;随机向量:向量的元素为随机变量或随机过程。

复随机变量的内积:$\langle\boldsymbol{x}(\xi), \boldsymbol{y}(\xi)\rangle=E\left{\boldsymbol{x}^{\mathrm{H}}(\xi) \boldsymbol{y}(\xi)\right}$。若其正交,那么:$E\left{x^*(\xi) y(\xi)\right}=0 \Longleftrightarrow x(\xi) \perp y(\xi)$。

$Lp$范数:$|\mathbf{x}|_p=\left(\sum{n=1}^N\left|x_n\right|^p\right)^{1 / p}$。其性质:

(1)$|\mathbf{x}+\mathbf{y}|^2+|\mathbf{x}-\mathbf{y}|^2=2|\mathbf{x}|^2+2|\mathbf{y}|^2$。

(2)$|\mathbf{x}+\mathbf{y}| \leq|\mathbf{x}|+|\mathbf{y}|$。

(3)$|\langle\mathbf{x}, \mathbf{y}\rangle| \leq|\mathbf{x}| \cdot|\mathbf{y}|$。

(4)$\mathbf{x} \perp \mathbf{y} \Rightarrow|\mathbf{x}+\mathbf{y}|^2=|\mathbf{x}|^2+|\mathbf{y}|^2$。

对于随机变量$x(\xi)$来说,有:$\mathrm{E}{x(\xi)} \stackrel{\text { def }}{=} \int_{-\infty}^{\infty} x f(x) \mathrm{d} x$。

随机向量的自相关矩阵:

其中,$r{i i}=\mathrm{E}\left{\left|x_i(\xi)\right|^2\right}$(自相关函数),$r{i j}=\mathrm{E}\left{x_i(\xi) x_j^*(\xi)\right}$(互相关函数)。

随机向量的自协方差矩阵:

其中,$c{i i}=\mathrm{E}\left{\left|x_i(\xi)-\mu_i\right|^2\right}$(方差),$c{i j}=\mathrm{E}\left{\left[x_i(\xi)-\mu_i\right]\left[x_j(\xi)-\mu_j\right]^*\right}$(协方差)。

自相关矩阵与自协方差矩阵的关系:$\boldsymbol{C}x=\boldsymbol{R}_x-\boldsymbol{\mu}_x \boldsymbol{\mu}_x^{\mathrm{H}}$。同样,有互相关矩阵($\boldsymbol{R}{x y} \stackrel{\text { def }}{=} \mathrm{E}\left{\boldsymbol{x}(\xi) \boldsymbol{y}^{\mathrm{H}}(\xi)\right}$)与互协方差矩阵($\boldsymbol{R}_{x y}-\boldsymbol{\mu}_x \boldsymbol{\mu}_y^{\mathrm{H}}$)。

随机向量$\boldsymbol{x}(\xi)$与$\boldsymbol{y}(\xi)$统计不相关,即其互协方差矩阵为零矩阵。随机向量$\boldsymbol{x}(\xi)$与$\boldsymbol{y}(\xi)$正交,即其互相关矩阵为零矩阵。

向量应用

Euclidean距离:$DE(\mathbf{x}, \mathbf{s})=|\mathbf{x}-\mathbf{s}|_2$;Mahalanobis距离:$D_M(\mathbf{x}, \mathbf{u})=\sqrt{(\mathbf{x}-\mathbf{u})^T \mathbf{C}{\mathbf{x}}^{-1}(\mathbf{x}-\mathbf{u})}$。Mahalanobis距离优点:尺度无关,属性间关联。

矩阵的各种概念

非奇异矩阵:当且仅当方程组$\mathbf{A} \mathbf{x}=\mathbf{0}$,只有唯一解$x=0$。

矩阵的$Lp$范数:$|\mathbf{A}|_p=\left(\sum{m=1}^M \sum{n=1}^N\left|a{m n}\right|^p\right)^{\frac{1}{p}}$;矩阵的Frobenius范数:$|\mathbf{A}|_2$。

矩阵的内积:$\langle\mathbf{A}, \mathbf{B}\rangle=\langle\operatorname{vec}(\mathbf{A}), \operatorname{vec}(\mathbf{B})\rangle=\sum_{i=1}^N\left\langle\mathbf{a}_i, \mathbf{b}_i\right\rangle=\operatorname{tr}\left(\mathbf{A}^H \mathbf{B}\right)$。

矩阵范数与内积的关系:

(1)$|\langle\boldsymbol{A}, \boldsymbol{B}\rangle|^2 \leqslant|\boldsymbol{A}|^2|\boldsymbol{B}|^2$,等号成立当且仅当$\boldsymbol{A}=c \boldsymbol{B}$,$c$是某个复常数。

(2)$\langle\boldsymbol{A}, \boldsymbol{B}\rangle=0 \Rightarrow|\boldsymbol{A}+\boldsymbol{B}|^2=|\boldsymbol{A}|^2+|\boldsymbol{B}|^2$。

二次型:$\mathbf{x}^H \mathbf{A} \mathbf{x}$。正定矩阵:$\mathbf{x}^H \mathbf{A} \mathbf{x}>0, \forall \mathbf{x} \neq \mathbf{0}$,那么A对应的Hermitian矩阵是正定矩阵。

凸函数:$f(x)$是凸函数,当且仅当$\frac{\partial^2 f(\mathbf{x})}{\partial \mathbf{x} \partial \mathbf{x}^T} \succeq 0$。

行列式:$\operatorname{det}(\mathbf{A})=|\mathbf{A}|=\sum{j=1}^N a{i j}(-1)^{i+j} \operatorname{det}\left(\mathbf{A}_{i j}\right)$。性质:

(1)两行改变位置,行列式符号改变。

(2)$\operatorname{det}(\boldsymbol{A})=\operatorname{det}\left(\boldsymbol{A}^{\mathrm{T}}\right)$,$\operatorname{det}\left(\boldsymbol{A}^{\mathrm{H}}\right)=\left[\operatorname{det}\left(\boldsymbol{A}^{\mathrm{T}}\right)\right]^*$。

(3)奇异矩阵行列式为0。

(4)$\operatorname{det}(\mathbf{A} \mathbf{B})=\operatorname{det}(\mathbf{A}) \operatorname{det}(\mathbf{B})$。

(5)$\operatorname{det}(c \mathbf{A})=c^N \operatorname{det}(\mathbf{A})$。

(6)$\operatorname{det}\left(\mathbf{A}^{-1}\right)=1 / \operatorname{det}(\mathbf{A})$。

(7)正定矩阵行列式大于0。

(8)$\operatorname{det}\left[\begin{array}{ll}\mathbf{A} & \mathbf{B} \ \mathbf{C} & \mathbf{D}\end{array}\right]=\operatorname{det}(\mathbf{A}) \operatorname{det}\left(\mathbf{D}-\mathbf{C A}^{-1} \mathbf{B}\right)$。

特征值与特征向量:$\mathbf{A} \mathbf{u}=\lambda \mathbf{u}$,$\lambda$为特征值,$\mathbf{u}$为特征向量。有性质:(1)$\operatorname{det}(\mathbf{A}-\lambda \mathbf{I})=0$。(2)非奇异矩阵等价于特征值都不为0。(3)正定矩阵的特征值都大于0。

矩阵的迹:$\operatorname{tr}(\mathbf{A})=\sum{i=1}^N a{i i}$。其性质:

(1)$\operatorname{tr}(\mathbf{A}+\mathbf{B})=\operatorname{tr}(\mathbf{A})+\operatorname{tr}(\mathbf{B})$。

(2)$\operatorname{tr}(\mathbf{A} \mathbf{B})=\operatorname{tr}(\mathbf{B} \mathbf{A})$。

(3)$\operatorname{tr}(\mathbf{A})=\sum_{i=1}^N \lambda_i$。

(4)$\operatorname{tr}(A B C)=\operatorname{tr}(B C A)=\operatorname{tr}(C A B)$。

矩阵的秩:$\operatorname{rank}(\mathbf{A})$。矩阵A中线性无关行(列)的数目。性质:

(1)矩阵A的线性无关行数与线性无关列数相同。

(2)$\operatorname{rank}(\mathbf{A B}) \leq \min {\operatorname{rank}(\mathbf{A}), \operatorname{rank}(\mathbf{B})}$。

(3)$\operatorname{rank}(\mathbf{A}+\mathbf{B}) \leq \operatorname{rank}(\mathbf{A})+\operatorname{rank}(\mathbf{B})$。

(4)$\mathbf{A} \in \mathcal{C}^{M \times M}, \operatorname{rank}(\mathbf{A})=M \Leftrightarrow \operatorname{det}(\mathbf{A}) \neq 0 \Leftrightarrow \mathbf{A}$ 非奇异。

(5)$\operatorname{rank}(c \boldsymbol{A})=\operatorname{rank}(\boldsymbol{A})$。

适定方程:对于$\mathbf{A} \mathbf{x}=\mathbf{b}, \mathbf{A} \in \mathcal{C}^{m \times n}$,若$m=n$,且$rank(A)=n$,即矩阵A非奇异,则此矩阵方程为适定方程。

矩阵有逆=$\operatorname{rank}(\boldsymbol{A})=n$=$\operatorname{det}(\boldsymbol{A}) \neq 0$=非奇异。若$\mathbf{A}$非奇异,则有:

(1)$\boldsymbol{A}$ 为正交矩阵 $\Longleftrightarrow \boldsymbol{A}^{-1}=\boldsymbol{A}^{\mathrm{T}}$。

(2)$A$ 为酉矩阵 $\Longleftrightarrow A^{-1}=A^{\mathrm{H}}$。

(3)$\left(\boldsymbol{A}+\boldsymbol{x} \boldsymbol{y}^{\mathrm{H}}\right)^{-1}=\boldsymbol{A}^{-1}-\frac{\boldsymbol{A}^{-1} \boldsymbol{x} \boldsymbol{y}^{\mathrm{H}} \boldsymbol{A}^{-1}}{1+\boldsymbol{y}^{\mathrm{H}} \boldsymbol{A}^{-1} \boldsymbol{x}}$。

(4)$\left[\begin{array}{cc}\mathbf{A} & \mathbf{0} \ \mathbf{0} & \mathbf{D}\end{array}\right]^{-1}=\left[\begin{array}{cc}\mathbf{A}^{-1} & \mathbf{0} \ \mathbf{0} & \mathbf{D}^{-1}\end{array}\right]$。

(5)$\left[\begin{array}{cc}\mathbf{0} & \mathbf{U} \ \mathbf{V} & \mathbf{0}\end{array}\right]^{-1} \neq\left[\begin{array}{cc}\mathbf{0} & \mathbf{U}^{-1} \ \mathbf{V}^{-1} & \mathbf{0}\end{array}\right]$。

(6)$\left[\begin{array}{cc}\mathbf{A} & \mathbf{0} \ \mathbf{C} & \mathbf{D}\end{array}\right]^{-1}=\left[\begin{array}{cc}\mathbf{A}^{-1} & \mathbf{0} \ -\mathbf{D}^{-1} \mathbf{C A}^{-1} & \mathbf{D}^{-1}\end{array}\right]$。

(7)假设Hermitian矩阵的分块形式为:

那么有:

其中,$\boldsymbol{b}_m=-\boldsymbol{R}_m^{-1} \boldsymbol{r}_m$,$\beta_m=\rho_m-\boldsymbol{r}_m^{\mathrm{H}} \boldsymbol{R}_m^{-1} \boldsymbol{r}_m=\rho_m+\boldsymbol{r}_m^{\mathrm{H}} \boldsymbol{b}_m$。

(8)左逆矩阵:满足$\boldsymbol{L} \boldsymbol{A}=\boldsymbol{I}$的矩阵$L$称为$A$的左逆矩阵。且仅当$m \geqslant n$时,$\boldsymbol{A} \in C^{m \times n}$可能有左逆矩阵。

(9)左伪逆矩阵:若$m>n$,且A有满列秩,那么$\boldsymbol{L}=\left(\boldsymbol{A}^{\mathrm{H}} \boldsymbol{A}\right)^{-1} \boldsymbol{A}^{\mathrm{H}}$称为A的左伪逆矩阵。

(10)M-P逆矩阵:A是$m \times n$矩阵,若矩阵G满足以下四个条件,则称G是A的广义逆矩阵($\boldsymbol{A} \boldsymbol{G} \boldsymbol{A}=\boldsymbol{A}$):

a. $\boldsymbol{A G A}=A$。

b.$G A G=G$。

c.$\boldsymbol{A} \boldsymbol{G}$ 为Hermitian矩阵, 即 $(\boldsymbol{A} \boldsymbol{G})^{\mathrm{H}}=\boldsymbol{A} \boldsymbol{G}$。

d.$\boldsymbol{G} \boldsymbol{A}$ 为 Hermitian矩阵, 即 $(\boldsymbol{G} \boldsymbol{A})^{\mathrm{H}}=\boldsymbol{G} \boldsymbol{A}$。

(11)M-P逆矩阵的定义与计算:

计算:

(12)常见的M-P逆矩阵:对角矩阵的M-P逆矩阵是对角线上每个值的倒数。

Kronecker积:$m \times n$ 矩阵 $\boldsymbol{A}$ 和 $p \times q$ 矩阵 $\boldsymbol{B}$ 的右Kronecker积为:

直和:

Hadamard积:

相关性质:

(1)$m \times m$矩阵A、B是正定的,那么其hadamard积也是正定的。

(2)$\boldsymbol{A} \odot \boldsymbol{B}=\boldsymbol{B} \odot \boldsymbol{A}$。

(3)$(\boldsymbol{A} \odot \boldsymbol{B})^{\mathrm{T}}=\boldsymbol{A}^{\mathrm{T}} \odot \boldsymbol{B}^{\mathrm{T}}$。

(4)可以将$\odot$当作运算中的乘法来看。

(5)$(\boldsymbol{A} \oplus \boldsymbol{B}) \odot(\boldsymbol{C} \oplus \boldsymbol{D})=(\boldsymbol{A} \odot \boldsymbol{C}) \oplus(\boldsymbol{B} \odot \boldsymbol{D})$。

(6)A、B、C为$m \times n$矩阵,那么:$\operatorname{tr}\left(\boldsymbol{A}^{\mathrm{T}}(\boldsymbol{B} \odot \boldsymbol{C})\right)=\operatorname{tr}\left(\left(\boldsymbol{A}^{\mathrm{T}} \odot \boldsymbol{B}^{\mathrm{T}}\right) \boldsymbol{C}\right)$。

(7)若A、B、D为$m \times m$矩阵,那么:

$\boldsymbol{D}$ 为对角矩阵 $\Longrightarrow(\boldsymbol{D} \boldsymbol{A}) \odot(\boldsymbol{B} \boldsymbol{D})=\boldsymbol{D}(\boldsymbol{A} \odot \boldsymbol{B}) \boldsymbol{D}$

0x01 特殊矩阵

基本矩阵:$\mathbf{E}_{m n}=\mathbf{e}_m \mathbf{e}_n^T, M \times N$ 矩阵, 只有 $(m, n)$ 元素为 1。

移位矩阵(行移位):

正交矩阵:$n \times n$矩阵Q满足$\boldsymbol{Q} \boldsymbol{Q}^{\mathrm{T}}=\boldsymbol{Q}^{\mathrm{T}} \boldsymbol{Q}=\boldsymbol{I}$。酉矩阵:复数正方矩阵U满足$\boldsymbol{U} \boldsymbol{U}^{\mathrm{H}}=\boldsymbol{U}^{\mathrm{H}} \boldsymbol{U}=\boldsymbol{I}$。对应的还有半正交矩阵与仿酉矩阵。

酉矩阵的性质:对所有 $\boldsymbol{x} \in C^n$ 而言,$\boldsymbol{y}=\boldsymbol{U} \boldsymbol{x}$ 的Euclidean长度与 $\boldsymbol{x}$ 的Euclidean 长度相同,即 $\boldsymbol{y}^{\mathrm{H}} \boldsymbol{y}=\boldsymbol{x}^{\mathrm{H}} \boldsymbol{x}$ 。

酉变换:若线性变换矩阵 $A$ 为酉矩阵,则线性 变换 $\boldsymbol{A} \boldsymbol{x}$ 称为酉变换。酉等价:$\boldsymbol{B}=\boldsymbol{U}^{\mathrm{H}} \boldsymbol{A} \boldsymbol{U}$与$ \boldsymbol{A}$。正规矩阵:满足$\boldsymbol{A}^{\mathrm{H}} \boldsymbol{A}=\boldsymbol{A} \boldsymbol{A}^{\mathrm{H}}$。酉矩阵的性质:

(1)$\boldsymbol{A}_{m \times m}$ 为酉矩阵,其各种变换(逆矩阵、共轭矩阵、幂矩阵、转置矩阵)都是酉矩阵。

(2)两个酉矩阵的乘积也是酉矩阵,$\boldsymbol{A} \oplus \boldsymbol{B}$ 为酉矩阵,$A \otimes B$为酉矩阵。

(3)若$\boldsymbol{A}{m \times m}$ 为酉矩阵,则:$\operatorname{det}(\boldsymbol{A})$ 的绝对值等于1;$\operatorname{rank}(\boldsymbol{A})=m$;$\lambda$ 为 $\boldsymbol{A}$ 的特征值 $\Rightarrow|\lambda|=1$;$\boldsymbol{B}{m \times n} \Rightarrow|\boldsymbol{A B}|{\mathrm{F}}=|\boldsymbol{B}|{\mathrm{F}}$。

中心化矩阵:有$\mathbf{J}N=\left[\begin{array}{llll}\mathbf{1} & \mathbf{1} & \cdots & 1\end{array}\right]$,之后有$\mathbf{C}_N=\mathbf{I}_N-\frac{1}{N} \mathbf{J}_N$,即$\mathbf{C}_N \mathbf{x}=\left[x_1-\bar{x}, x_2-\bar{x}, \cdots, x_N-\bar{x}\right]^T$,最后有$\sum{n=1}^N\left(x_n-\bar{x}\right)^2=(\boldsymbol{C x})^{\mathrm{T}} \boldsymbol{C} \boldsymbol{x}=\boldsymbol{x}^{\mathrm{T}} \boldsymbol{C} \boldsymbol{x}$。这说明:数据向量 $\boldsymbol{x}$ 的协方差可以用核矩阵为中心化矩阵的二次型 $\boldsymbol{x}^{\mathrm{T}} \boldsymbol{C} \boldsymbol{x}$ 表示。

相似矩阵:若存在非奇异矩阵$\boldsymbol{S} \in$ $C^{n \times n}$,使得 $\boldsymbol{B}=\boldsymbol{S}^{-1} \boldsymbol{A} \boldsymbol{S}$,那么矩阵$\boldsymbol{B}$称为矩阵$\boldsymbol{A}$的相似矩阵。相似矩阵具有自反性、对称性、传递性。其性质有:

(1)相似矩阵的行列式相等, 并具有相同的迹。

(2)相似矩阵的特征多项式相同,特征值相同。

(3)相似矩阵的逆也相似。

相合矩阵:令 $\boldsymbol{A}, \boldsymbol{B}, \boldsymbol{C} \in C^{n \times n}$,并 且 $\boldsymbol{C}$ 非奇异,则矩阵 $B=C^{\mathrm{H}} \boldsymbol{A} \boldsymbol{C}$ 称为 $\boldsymbol{A}$ 的相合矩阵 (congruent matrix)。其性质有:

(1)相合矩阵的正定性一致。且有自反、对称、传递性。

(2)$\mathbf{A}$ 是正定 Hermitian矩阵 $\Rightarrow\left{\begin{array}{l}\mathbf{A}=\mathbf{T}^H \mathbf{D T} \ \mathbf{A}=\mathbf{L}^H \mathbf{L}\end{array}\right.$,

其中,$\mathbf{T}$ 上三角矩阵, $\mathbf{D}$ 对角矩阵, $\mathbf{T}$ 下三角矩阵。

Vandermonde矩阵:

其行列式如下:

Fourier矩阵:离散时间信号 $x(0), x(1), \cdots, x(N-1)$ 的Fourier变换 称为离散Fourier变换(DFT),定义为

写成矩阵形式,则有:

简记作$\hat{\boldsymbol{x}}=\boldsymbol{F} \boldsymbol{x}$,其中 $\boldsymbol{F}$ 称为Fourier矩阵。其中,$x$与$\hat{x}$分别是离散时间信号向量和其频谱向量。其性质如下:

(1)对称矩阵,即 $\boldsymbol{F}^{\mathrm{T}}=\boldsymbol{F}$。

(2)Fourier矩阵的逆矩阵等于Fourier矩阵的共轭矩阵,即 $\boldsymbol{F}^{-1}=\boldsymbol{F}^*$ 。

(3)$\boldsymbol{F}^2=\boldsymbol{P}=\left[\boldsymbol{e}1, \boldsymbol{e}_n, \boldsymbol{e}{n-1}, \cdots, \boldsymbol{e}_2\right]$,$\boldsymbol{e}_k$ 是仅第 $k$ 个元素为 1 , 其他元素皆为 0 的向量。

(4)$\boldsymbol{F}^4=\boldsymbol{I}$。

(5)$\sqrt{n} \boldsymbol{F}=\boldsymbol{C}+\mathrm{j} \boldsymbol{S}$, 其中, 矩阵 $\boldsymbol{C}$ 和 $\boldsymbol{S}$ 的第 $i$ 行和第 $j$ 列 的元素分别为:

(6)$\boldsymbol{C} \boldsymbol{S}=\boldsymbol{S} \boldsymbol{C}$、$\boldsymbol{C}^2+\boldsymbol{S}^2=\boldsymbol{I}$。

Hadamard矩阵:所有元素取 +1 或者 -1 , 并且满足:

的 $n \times n$ 矩阵。其性质有:

(1)$\frac{1}{\sqrt{n}} \boldsymbol{H}_n$ 为标准正交矩阵。

(2)构造Hadamard矩阵:

Toeplitz矩阵:

对称Toeplitz矩阵则是满足对称关系 $a_{-i}=a_i$的Toeplitz矩阵。

0x02 矩阵的微分

有几个公式:

例题1:$A=\left[\begin{array}{ll}1 & 1 \ 0 & 0\end{array}\right], B=\left[\begin{array}{cc}1 & -1 \ 0 & 0\end{array}\right]$。求 $e^A, e^B$ 及 $e^{A+B}$。

解题步骤:

例题2:$A{n \times n}, B{n \times n}, A B=B A \Rightarrow e^A e^B=e^B e^A=e^{A+B}$

解题步骤:

其他性质:

(1)$e^A e^{-A}=e^o=I \Rightarrow\left(e^A\right)^{-1}=e^{-A} \quad\left(\forall A_{n \times n}\right)$。

(2)$\left(e^A\right)^m=e^{m A}$。

例题3:$A{n \times n}, B{n \times n}, A B=B A$,证明:

解题步骤:第一个式子中,

设$P^{-1} A P=\left[\begin{array}{lll}\lambda_1 & & \ & \ddots & \ & & \lambda_n\end{array}\right] \stackrel{\Delta}{=} \quad$,则 $A^k=P \Lambda^k P^{-1}$,那么有:

因此,有:

矩阵函数分为3种:

(1)标量函数。$f: \mathbb{R}^{m \times n} \rightarrow \mathbb{R}$。

(2)向量函数。$\boldsymbol{f}: \mathbb{R}^{m \times n} \rightarrow \mathbb{R}^p$。

(3)矩阵函数。$\boldsymbol{F}: \mathbb{R}^{m \times n} \rightarrow \mathbb{R}^{p \times q}$。

对于标量函数$f(X)$,其求偏导(行偏导)为:

若直接以矩阵形式求偏导,则为:

$\mathrm{D}{\mathrm{vec}^{\mathrm{T}}(\boldsymbol{X})} f(\boldsymbol{X})$ 和 $\mathrm{D}{\boldsymbol{X}} f(\boldsymbol{X})$ 分别称为标量函数 $f(\boldsymbol{X})$ 在 $\boldsymbol{X}$ 的行向量偏导和Jacobian矩阵。

相应的,列偏导算子通常称之为梯度算子。其关系为:$\nabla{\mathbf{X}} f(\mathbf{X})=\mathrm{D}{\mathbf{X}}^{\mathrm{T}} f(\mathbf{X})$。梯度方向的负方向称为变元 $x$ 的梯度流(gradient flow),记作:$\dot{\boldsymbol{x}}=-\nabla_x f(\boldsymbol{x})$。梯度向量指出了当变元增大时实值标量函数 $f(\boldsymbol{x})$ 的最大增大率。相反,梯度的负值(简称负梯度) 则指出了当变元增大时函 数 $f(\boldsymbol{x})$ 的最大减小率。

向量函数的偏导定义如下:

这可以叫做向量函数 $\boldsymbol{f}(\boldsymbol{x})$ 在 $\boldsymbol{x}$ 处的Jacobian矩阵或协梯度矩阵。

矩阵函数 $\boldsymbol{F}(\boldsymbol{X})$ 的行向量偏导定义为:

标量函数的微分:

其中,有:

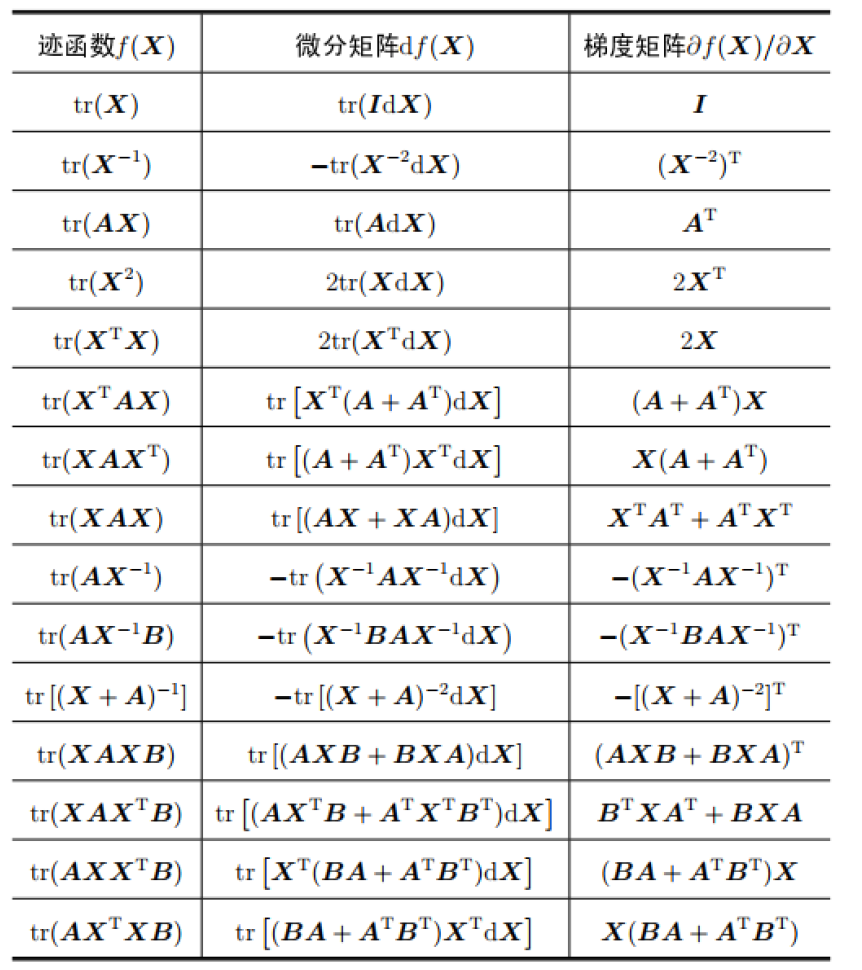

因此,可以总结出求 $f(\mathbf{X})$ 梯度矩阵 $\nabla_x f(\mathbf{X})$ 的方法:

(1)求实值目标函数 $f(\boldsymbol{X})$ 相对于变元矩阵 $\boldsymbol{X}$ 的 矩阵微分 $\mathrm{d} f(\boldsymbol{X})$, 并将其表示成规范形式 $\mathrm{d} f(\boldsymbol{X})=\operatorname{tr}(\boldsymbol{A} \mathrm{d} \boldsymbol{X})$。

(2)实值目标函数 $f(\boldsymbol{X})$ 相对于 $m \times n$ 变元矩阵 $\boldsymbol{X}$ 的 梯度矩阵由 $\nabla f(\boldsymbol{X})=\frac{\partial f(\boldsymbol{X})}{\partial \boldsymbol{X}}=\boldsymbol{A}^{\mathrm{T}}$ 直接给出。

实矩阵微分的性质:

(1)$\mathrm{d}\left(\boldsymbol{X}^{\mathrm{T}}\right)=(\mathrm{d} \boldsymbol{X})^{\mathrm{T}}$。

(2)$\mathrm{d}(\alpha \boldsymbol{X}+\beta \boldsymbol{Y})=\alpha \mathrm{d} \boldsymbol{X}+\beta \mathrm{d} \boldsymbol{Y}$。

(3)$\mathrm{d}(\operatorname{tr} \boldsymbol{U})=\operatorname{tr}(\mathrm{d} \boldsymbol{U})$。

(4)$\mathrm{d}(\operatorname{tr}(\mathbf{F}(\mathbf{X})))=\operatorname{tr}(\mathrm{d}(\mathbf{F}(\mathbf{X})))$。

(5)$\mathrm{d}(\operatorname{tr}(\mathbf{X}))=\operatorname{tr}(\mathrm{d}(\mathbf{X})), \quad \mathrm{d}\left(\operatorname{tr}\left(\mathbf{X}^{\mathrm{T}} \mathbf{X}\right)\right)=2 \operatorname{tr}\left(\mathbf{X}^{\mathrm{T}} \mathrm{d} \mathbf{X}\right)$。

(6)$\mathrm{d}|\mathbf{X}|=|\mathbf{X}| \operatorname{tr}\left(\mathbf{X}^{-1} \mathrm{~d} \mathbf{X}\right)$。

(7)$\mathrm{d} \log |\mathbf{F}(\mathbf{X})|=|\mathbf{F}(\mathbf{X})|^{-1} \mathrm{~d}|\mathbf{F}(\mathbf{X})|, \quad \mathrm{d} \log |\mathbf{X}|=|\mathbf{X}|^{-1} \mathrm{~d}|\mathbf{X}|$。

(8)$\mathrm{d}\left(\mathbf{X}^{-1}\right)=-\mathbf{X}^{-1}(\mathrm{~d} \mathbf{X}) \mathbf{X}^{-1}$。

(9)有以下式子:

(10)$\mathrm{d}\left(\mathbf{X}^T \mathbf{A} \mathbf{X}\right)=\mathrm{d}(\mathbf{X})^T \mathbf{A} \mathbf{X}+\mathbf{X}^T \mathbf{A} \mathrm{d}(\mathbf{X})$。

例题1:

因此有:

例题2:

因此有:

例题3:

因此有:

例题4:

因此有:

实值标量函数满足的性质:

(1)$f(\boldsymbol{X})=\operatorname{tr}(f(\boldsymbol{X}))$。

(2)$\operatorname{tr}\left[\boldsymbol{A}(\mathrm{d} \boldsymbol{X})^{\mathrm{T}} \boldsymbol{B}\right]=\operatorname{tr}\left[\left(\boldsymbol{A}(\mathrm{d} \boldsymbol{X})^{\mathrm{T}} \boldsymbol{B}\right)^{\mathrm{T}}\right]=\operatorname{tr}\left(\boldsymbol{A}^{\mathrm{T}} \boldsymbol{B}^{\mathrm{T}} \mathrm{d} \boldsymbol{X}\right)$。

(3)$d(X)$总是可以写到最右端。

迹函数的微分矩阵与梯度矩阵的关系:

例题1:已知 $\mathrm{d}|\mathbf{X}|=|\mathbf{X}| \operatorname{tr}\left(\mathbf{X}^{-1} \mathrm{~d} \mathbf{X}\right)$,求下列函数 $|\mathbf{F}(\mathbf{X})|$ 的梯度矩阵: $\log |\mathbf{X}|,\left|\mathbf{X}^k\right|,|\mathbf{A X B}|,\left|\mathbf{X} \mathbf{A} \mathbf{X}^T\right|$。

解:

(1)

因此梯度矩阵有:

(2)

因此梯度矩阵有:

(3)

因此梯度矩阵有:

(4)

因此有:

对于矩阵函数而言,有:$\mathrm{d}(\operatorname{vec} \mathbf{F}(\mathbf{X}))=\mathbf{A d}(\operatorname{vec} \mathbf{X})$,其中$\mathbf{A}=\frac{\partial \operatorname{vec} \mathbf{F}(\mathbf{X})}{\partial \operatorname{vec}^T(\mathbf{X})}$。

例题1:已知$\mathrm{d}(\operatorname{vec} \mathbf{F}(\mathbf{X}))=\mathbf{A d v e c}(\mathbf{X})$,其中$\mathbf{A}=\mathrm{D}_{\mathbf{X}} \mathbf{F}(\mathbf{X})$,求下列 $\mathbf{F}(\mathbf{X})$ 的梯度矩阵: $\mathbf{A X B} 、 \mathbf{A X}{ }^{-1} \mathbf{B} 、 \mathbf{X}^T \mathbf{A X}, \mathbf{X A X ^ { T }}$。

解:

(1)

根据教材中的式子,可以得到:

由Jacobian矩阵的定义有:

(2)

根据教材中的式子,可以得到:

由Jacobian矩阵的定义有:

(3)

根据教材中的式子,且由:$\mathrm{d}\left(\operatorname{vec} \boldsymbol{X}^{\mathrm{T}}\right)=\boldsymbol{K}{m n} \operatorname{vec}(\mathrm{d} \boldsymbol{X})$,其中$\boldsymbol{K}{m n}$为交换矩阵,可以得到:

由Jacobian矩阵的定义有:

(4)

标量函数的Hessian矩阵:实值函数 $f(\boldsymbol{x})$ 相对于 $m \times 1$ 实向量 $\boldsymbol{x}$ 的二阶偏导是一个由 $m^2$ 个二阶偏导组成的矩阵(称为Hessian矩阵),定义为:

可以写作:

类似的,有:

0x03 共轭梯度与无约束优化

梯度:目标函数相对于复向量或者复矩阵本身的梯度;共轭梯度:目标函数相对于复共轭向量或者复共轭矩阵的梯度。

复变函数:$f(z)=u(x, y)+\mathrm{j} v(x, y)$,其中$z=x+\mathrm{j} y$,$u(x,y)$与$v(x,y)$是实值函数。全纯函数(复解析函数)的等价说法:

(1)复变函数的导数 $f^{\prime}(z)$ 存在,并且连续。

(2)$\frac{\partial u}{\partial x}=\frac{\partial v}{\partial y} \quad$、$\quad \frac{\partial v}{\partial x}=-\frac{\partial u}{\partial y}$。(Cauchy-Riemann条件)

(3)复变函数 $f(z)$ 的所有导数存在并具有一个收敛的幂级数。

幂函数 $z^n$ 、指数函数 $\mathrm{e}^z$ 、对数函数 $\ln z$ 、正弦函数 $\sin z$ 和余弦函数 $\cos z$ 等许多函数都是全纯函数,即全复平面上的解析函数。但是好多函数不是全纯函数,例如:$f(z)=z^*=x-\mathrm{j} y$等。

如果将一个非全纯函数 $f(z)$ 写成$f\left(z, z^*\right)$的形式,则对于固定的$z^*$,复变函数$f\left(z, z^*\right)$在 $z=x+\mathrm{j} y$ 全平面是解析的, 并且对于固定的 $z$ ,复变函数$f\left(z, z^*\right)$ 在 $z^*=x-\mathrm{j} y$ 全平面上也是解析的。换句话说,一个复变函数写成 $f\left(z, z^*\right)$ 之后,则其偏导与共轭偏导如下:

复变函数偏导的常用公式:

(1)

(2)

(3)复微分法则:

(4)链式法则:

用复变向量 $z$ 的实部 $x$ 与虚部 $y$ 表示的协梯度算子(行向量,如果用列向量的话就叫做梯度算子):

及其共轭协梯度算子:

还有以下结果:

其中某式子的推导如下:

行向量(协梯度向量)总是在分母有转置,而列向量(梯度向量)则没有转置。

Hessian矩阵(共轭梯度的协梯度):

梯度矩阵运算法则:线性法则、乘积法则(与之前一样)、商法则(如下所示)。

多变元复变函数 $f(\cdot)=f\left(\left(z_1, z_1^*\right), \cdots,\left(z_m, z_m^*\right)\right)$ 的复微分法则:

利用上述法则,可以得到:

考虑以矩阵作变元的复变函数 $f\left(\boldsymbol{Z}, \boldsymbol{Z}^*\right)$,则有:

其中,有:

令$\boldsymbol{A}=\mathrm{D}z f\left(\boldsymbol{Z}, \boldsymbol{Z}^*\right) \quad$ 和 $\quad \boldsymbol{B}=\mathrm{D}{z^*} f\left(\boldsymbol{Z}, \boldsymbol{Z}^*\right)$,则有:

因此,式子可以变为:

利用$\operatorname{tr}\left(\boldsymbol{C}^{\mathrm{T}} \boldsymbol{D}\right)=\operatorname{vec}^{\mathrm{T}}(\boldsymbol{C}) \operatorname{vec}(\boldsymbol{D})$,可以变为:

例题1:迹函数 $\operatorname{tr}\left(\boldsymbol{X} \boldsymbol{A} \boldsymbol{X}^* \boldsymbol{B}\right)$ 的复矩阵微分

由此得迹函数 $\operatorname{tr}\left(\boldsymbol{X} \boldsymbol{A} \boldsymbol{X}^* \boldsymbol{B}\right)$ 的梯度矩阵和共轭梯度矩阵分别为:

例题2:行列式 $\left|\boldsymbol{X} \boldsymbol{X}^*\right|$的复矩阵微分为:

无约束优化

如果函数 $f(x)$ 是连续二阶可微分的,求该函数的局部极小点最简单的方法是联合求解:

凸函数(严格就是没有等于):函数 $f(x)$ 称为凸函数,若对于任意选择的点 $x_1$ 和 $x_2$ 及标量 $a \neq 0$,函数满足

对于凸的目标函数,局部极小点直接给出全局极小点。

推广到矩阵后,如果 $f(\boldsymbol{x})$ 二次连续可微分,则可直接通过检验梯度 $\nabla \boldsymbol{x} f\left(\boldsymbol{x}*\right)$ 是否为 $\mathbf{0}$ 以及Hessian矩 阵 $\nabla{\boldsymbol{x}}^2 f\left(\boldsymbol{x}*\right)$ 是否正定来判断 $\boldsymbol{x}*$ 是否为局部或全局极小点。

例题1:有函数$J(\boldsymbol{W})=\frac{1}{2}\left[\operatorname{tr}\left(\log \left(\boldsymbol{W}^{\mathrm{T}} \boldsymbol{R} \boldsymbol{W}\right)\right)-\operatorname{tr}\left(\boldsymbol{W}^{\mathrm{T}} \boldsymbol{W}\right)\right]$,其中$\boldsymbol{W}$ 是一个 $n \times r$ 矩阵、$\boldsymbol{R}=$ $\mathrm{E}\left{\boldsymbol{x}_k \boldsymbol{x}_k^{\mathrm{T}}\right} \in R^{n \times n}$ 为观测数据向量的自相关矩阵。求目标函数的一阶微分,得:

其梯度矩阵为:

令其等于零矩阵,可以得到:$\boldsymbol{W}^{\mathrm{T}} \boldsymbol{W}=\boldsymbol{I}$。即学习算法可以保证,神经网络的突触权矩阵W收敛为半正交矩阵。

定理:若目标函数 $f\left(z, z^*\right)$ 是复变量 $z$ 和 $z^*$ 的实值函数,并且相对于 $z$ 和 $z^*$ 是解析的,则目标函数的所有平稳点可以通过令 $\frac{\partial f\left(z, z^*\right)}{\partial z}=0$ 或者 $\frac{\partial f\left(z, z^*\right)}{\partial z^*}=0$ 求出。

Hessian矩阵可具体写作:

复向量变元情形下目标函数 $f(\boldsymbol{w})$ 的局部极小点条件:

例题1:分析实目标函数 $f(\boldsymbol{w})=\boldsymbol{w}^{\mathrm{H}} \boldsymbol{A} \boldsymbol{w}$ 的极值性,其中,$\boldsymbol{A}$ 是一个对称和正定的矩阵。

解:该二次型目标函数是严格凸的函数。当 $A$ 为对称矩阵时, 容易求得该目标函数的共轭梯度 为 $\nabla_{w^*} f(\boldsymbol{w})=\boldsymbol{A} \boldsymbol{w}$ 。令 $\boldsymbol{A} \boldsymbol{w}=\mathbf{0}$, 得唯一的稳定 点 $\boldsymbol{w}=\mathbf{0}$ 。

进一步地, 又可求得目标函数的Hessian矩 阵 $\nabla{w^{\mathrm{T}}}\left[\nabla{w^*} f(\boldsymbol{w})\right]=\boldsymbol{A}$ 。由于矩阵 $\boldsymbol{A}$ 是正定的, 故Hessian矩阵在 $\boldsymbol{w}$ 的任何点都是正定的。

根据上述充分条件立即知, 目标函数在原 点 $\boldsymbol{w}=0$ 取严格局部极小值。这个唯一的极小 值就是目标函数的最小值。

例题2: 考查求解超定矩阵方程 $\boldsymbol{A} \boldsymbol{w}=\boldsymbol{b}$ 的最大似然方法。

解:定义对数似然函数

式中,$C$ 为一常数,$e$ 为误差向量 $e=b-A \hat{\boldsymbol{w}}$ 。 于是,有:

求对数似然函数相对于 $\hat{\boldsymbol{w}}$ 的共轭梯度,则:

令其等于0,那么有:$\boldsymbol{w}_{\mathrm{opt}}=\left(\boldsymbol{A}^{\mathrm{H}} \boldsymbol{A}\right)^{-1} \boldsymbol{A}^{\mathrm{H}} \boldsymbol{b}$,即为矩阵方程$\boldsymbol{A} \boldsymbol{w}=\boldsymbol{b}$ 的最大似然解。

例题3: 考查最优化问题 $\min \boldsymbol{w}^{\mathrm{H}} \boldsymbol{A} \boldsymbol{w}$ (其中 $\boldsymbol{A}$ 正定),其全局极小点为 $w=0$ 。若加上约束条件 $\boldsymbol{w}^{\mathrm{H}} \boldsymbol{w}=1$,则等价为无约束最优化问题:

由 $\frac{\partial J(\boldsymbol{w}, \lambda)}{\partial \boldsymbol{w}^*}=\mathbf{0}$,得:

这表明,最优化问题的解向量是矩阵 $A$ 与最小特征值对应的特征向量。

0x04 奇异值分解

定理:令 $\boldsymbol{A} \in \mathbb{R}^{m \times n}\left(\right.$ 或 $\left.\mathbb{C}^{m \times n}\right)$,则存在正交(或酉)矩阵 $\boldsymbol{U} \in \mathbb{R}^{m \times m}$ 和 $\boldsymbol{V} \in$ $\mathbb{R}^{n \times n}$ 使得

其中:

且 $\boldsymbol{\Sigma}_1=\operatorname{diag}\left(\sigma_1, \sigma_2, \cdots, \sigma_r\right)$,其对角元素按照由大到小 顺序排列,即 $\sigma_1 \geqslant \sigma_2 \geqslant \cdots \geqslant \sigma_r>0, \quad r=\operatorname{rank}(\boldsymbol{A})$ 。

$n \times n$ 矩阵 $\boldsymbol{V}$ 为酉矩阵, 用 $\boldsymbol{V}$ 右乘上述式子,得 $\boldsymbol{A} \boldsymbol{V}=\boldsymbol{U} \boldsymbol{\Sigma}$,其列向量形式为:

因此, $V$ 的列向量 $\boldsymbol{v}_i$ 称为矩阵 $A$ 的右奇异向量(right singular vector), $V$ 称为 $A$ 的右奇异向量矩阵(right singular vector matrix)。同样,左奇异向量也是这样。

用 $\boldsymbol{u}_i^{\mathrm{H}}$ 左乘上述式子,并注意到 $\boldsymbol{u}_i^{\mathrm{H}} \boldsymbol{u}_i=1$,易得:

或写成:

当矩阵 $\boldsymbol{A}$ 的秩 $r=\operatorname{rank}(\boldsymbol{A})<\min {m, n}$ 时, 由于奇异值 $\sigma{r+1}=\sigma{r+2}=\cdots=\sigma_h=0, h=$ $\min {m, n}$,故奇异值分解公式可以简化为:

其中,有:

也可以携程向量表达的形式:

如果矩阵 $\boldsymbol{A}_{m \times n}$ 具有秩 $r$,则:

(1) $m \times m$ 酉矩阵 $\boldsymbol{U}$ 的前 $r$ 列组成矩阵 $\boldsymbol{A}$ 的列空 间的标准正交基。

(2) $n \times n$ 酉矩阵 $\boldsymbol{V}$ 的前 $r$ 列组成矩阵 $\boldsymbol{A}$ 的行空 间(或 $A^{\mathrm{H}}$ 的列空间)的标准正交基。

矩阵A的最佳秩 $k$ 逼近(就是前$k$个最大的秩):$\quad k<r=\operatorname{rank}(\boldsymbol{A})$

则 $\boldsymbol{A}_k$ 是如下优化问题的解:

非零奇异值的个数 $r$ 和它们的值 $\sigma_1, \sigma_2, \cdots, \sigma_r$ 相 对于矩阵 $A$ 是唯一确定的。但左右奇异向量矩阵 $\boldsymbol{U}, \boldsymbol{V}$ 却不是唯一的。其性质有:

(1)矩阵 $\boldsymbol{A}$ 和 $\boldsymbol{A}^{\mathrm{H}}$ 具有完全相同的奇异值。

(2)奇异值具有酉不变性,但奇异向量不同。(指的是左右同乘酉矩阵,奇异值不变,而左右奇异向量发生改变。)

(3)$\boldsymbol{A}^{\mathrm{H}} \boldsymbol{A}, \boldsymbol{A} \boldsymbol{A}^{\mathrm{H}}$ 的奇异值分解分别为:

其中:

注 : $\boldsymbol{A}^{\mathrm{H}} \boldsymbol{A}$ 和 $\boldsymbol{A} \boldsymbol{A}^{\mathrm{H}}$ 均为 Hermitian矩阵。Hermitian 矩阵的奇异值分解与特征值分解是一致的。

(4)$m \times n$ 矩阵 $\boldsymbol{A}$ 的奇异值分解与 $n \times m$ 维MoorePenrose广义逆矩阵 $\boldsymbol{A}^{\dagger}$ 之间存在下列关系:

(5)矩阵 $A$ 的谱范数等于 $A$ 的最大奇异值:

(6)Frobenius范数:

$\begin{aligned}|\boldsymbol{A}|{\mathrm{F}} & =\left[\sum{i=1}^m \sum{j=1}^n\left|a{i j}\right|^2\right]^{1 / 2}=\left|\boldsymbol{U}^{\mathrm{H}} \boldsymbol{\Sigma} \boldsymbol{V}\right|{\mathrm{F}} \ & =|\boldsymbol{\Sigma}|{\mathrm{F}}=\sqrt{\sigma_1^2+\sigma_2^2+\cdots+\sigma_r^2}\end{aligned}$

(7)只要有一个奇异值为零, 则正方矩阵奇异。

考查对象:$A x=b$;考查手段:研究方程的解向量 $\boldsymbol{x}$ 如何受系数矩阵 $A$ 和系数向量 $b$ 的元素微小变化(扰动)的影响,将得到描述矩阵 $\boldsymbol{A}$ 的一个重要特征的数值,称为条件数(condition number)。可以得到:

而:

因此, (1) 条件数是一个大于或等于 1 的正数;(2) 奇异矩阵的条件数为无穷大。(3)$\operatorname{cond}\left(\boldsymbol{A}^{\mathrm{H}} \boldsymbol{A}\right)=\sigma_1^2 / \sigma_p^2=[\operatorname{cond}(\boldsymbol{A})]^2$。

奇异值与特征值的关系:

(1) 非正方矩阵 $\boldsymbol{A}$ 的非零奇异值等于矩阵 $A^{\mathrm{H}} \boldsymbol{A}$ 或者 $\boldsymbol{A} \boldsymbol{A}^{\mathrm{H}}$ 的非零特征值的正平方根。

(2) 设 $n \times n$ 正方矩阵 $\boldsymbol{A}$ 的特征值为 $\lambda_1, \lambda_2$, $\cdots, \lambda_n\left(\left|\lambda_1\right| \geqslant\left|\lambda_2 \geqslant \cdots \geqslant\right| \lambda_n \mid\right)$, 奇异值为 $\sigma_1, \sigma_2$, $\cdots, \sigma_n\left(\sigma_1 \geqslant \sigma_2 \geqslant \cdots \geqslant \sigma_n \geqslant 0\right)$,则:

等号成立的条件是A对称。

奇异值分解作用1:系统稳定性矫正

(1) 如何刻画一个模型方程的数值稳定性? (2)何将一个存在误差或者扰动的模型方程变为数值稳定性高的模型? $\quad \rightarrow$ SVD

变为:

$\boldsymbol{F}=\boldsymbol{U}^{\mathrm{T}} \boldsymbol{\Sigma} \boldsymbol{V} \text {,其中 } \boldsymbol{\Sigma}=\operatorname{daig}\left(\sigma_1, \cdots, \sigma_r, 0, \cdots, 0\right) \text { 。 }$

由于 $U$ 为正交矩阵,故:

将奇异值矩阵 $\boldsymbol{\Sigma}$ 分块为:

最后得到:

如果 $\boldsymbol{F}$ 中所有奇异值非零,则可以将 “小” 奇 异值置零,按照上述方法得到修正的模型,则可以在逼近系统性能的同时提高系统对数值扰动或测量噪声的鲁棒性。

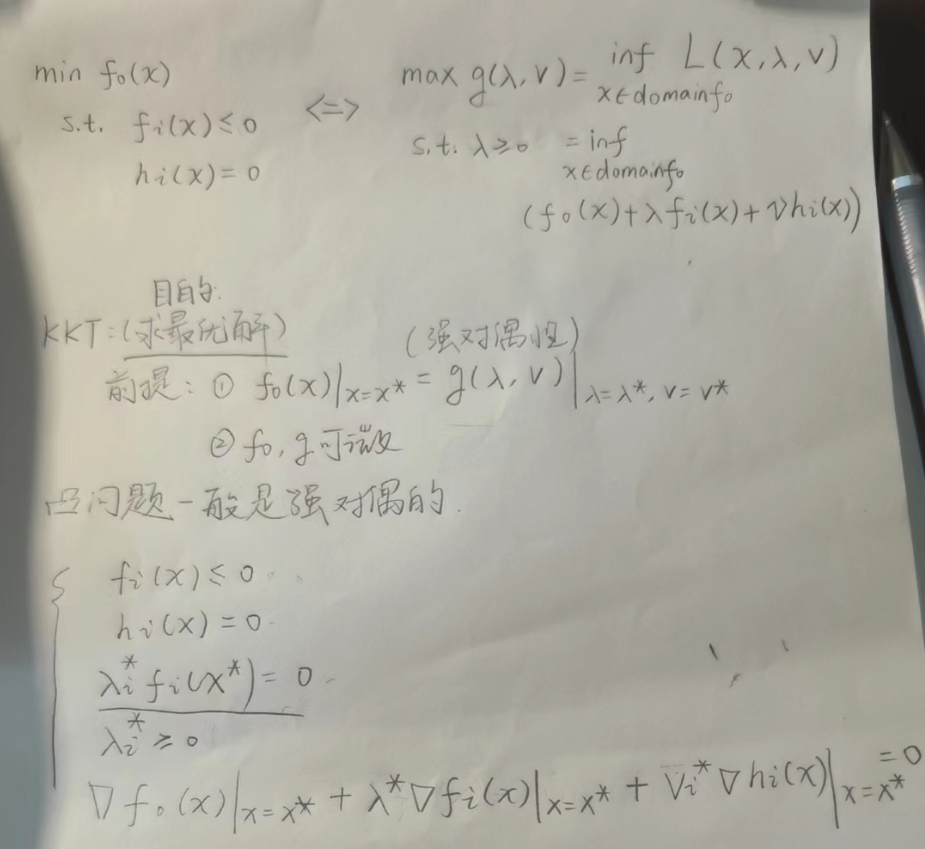

0x05 凸优化基础

为什么要研究凸优化?

(1)判断一个问题是否为凸的

(2)将一个问题转化为凸的

(3)求解凸优化问题,给出算法性能

优化问题的一般形式:

其中 $f_0$ 为优化目标, $f_i$ 为约束函数。如果目标函数和约束函数都是凸函数,则为凸优化问题。 满足以下条件的函数称为凸函数:

凸集:$x_1, x_2 \in C, \quad 0 \leq \theta \leq 1 \quad \Longrightarrow \quad \theta x_1+(1-\theta) x_2 \in C$。椭球:$\left{x \mid\left(x-x_c\right)^T P^{-1}\left(x-x_c\right) \leq 1\right}$。凸锥:$x_1, x_2 \in C \Rightarrow x=\theta_1 x_1+\theta_2 x_2 \in C$。

半正定锥:$\mathbf{S}^n$ 为 $n$ 阶对称矩阵,$\mathbf{S}_{+}^n=\left{X \in \mathbf{S}^n \mid X \succeq 0\right}$ 为对称半正定矩阵,为凸雉。

保证为凸集的变换:

(1)任意个(可以是无数个)凸集的交集仍然是凸集。

(2)仿射变换。若映射 $f: \mathbf{R}^n \rightarrow \mathbf{R}^m$ 是仿射变换。

(3)投影函数。投影函数 $P: \mathbf{R}^{n+1} \rightarrow \mathbf{R}^n$

常见凸函数:

(1)仿射函数 $a x+b ,$ for any $a, b \in R$

(2)指数函数 $e^{a x}$ , for any $a \in R$

(3)幂函数 $x^\alpha, x \in R_{++}$, for $\alpha \geq 1$ or $\alpha \leq 0$

(4)绝对值幂函数 $|x|^p, x \in R$ , for $p \geq 1$

(5)负熵 $x \log x, x \in R_{++}$

(6)范数 $|x|_p, p \geq 1$

常见凹函数:

(1)仿射函数 $a x+b ,$ for any $a, b \in R$

(2)幂函数 $x^\alpha, x \in R_{++}$, for $0 \leq \alpha \leq 1$

(3)对数函数 $\log x, x \in R_{++}$

凸函数判断:

(1)若对于任意一个方向上都是凸函数,则$f$就是凸函数。

(2)函数 $f$ 为凸函数当且仅当$f(y) \geq f(x)+\nabla f^T(x)(y-x) \quad \forall x, y \in \operatorname{dom} f$。

(3)函数 $f$ 为凸函数当且仅当Hessian matrix有:

下水平集与上方函数

函数 $f: R^n \rightarrow R$ 的 $\alpha$ 下水平集 ( $\alpha$-sublevel set) 的定义为:

凸函数的下水平集也是凸集,但是反之不一定成立。

保持函数凸的操作

(1)正权重求和:

离散情况: $f=\sum \omega_i f_i, \omega_i \geq 0$

连续情况: $f=\int \omega(y) f(y) d y, \omega(y) \geq 0$

(2)仿射变换:若 $f$ 为凸函数,则 $f(A x+b)$ 也为凸函数。

(3)逐元素最大值&上(下) 确界。

若 $f_i$ 均为凸函数,则 $f(x)=\max _i\left{f_1(x), \ldots, f_n(x)\right}$ 也为凸函数。

这实际上可以看成是 epi $f=\bigcap$ epi $f_i$ ,多个凸集的交集仍然是凸集。

透视函数:函数 $f: R^n \rightarrow R$ 的透射变换 $g: R^n \times R \rightarrow R$ 定义为

若 $f$ 是凸的, 则 $g$ 是凸的。

凸优化问题一般形式

其中要求目标函数和约束函数 $f_0, f_1, \ldots, f_m$ 均为凸函数。

凸优化问题的局部最优解就是全局最优解。

凸优化的例子:二次规划

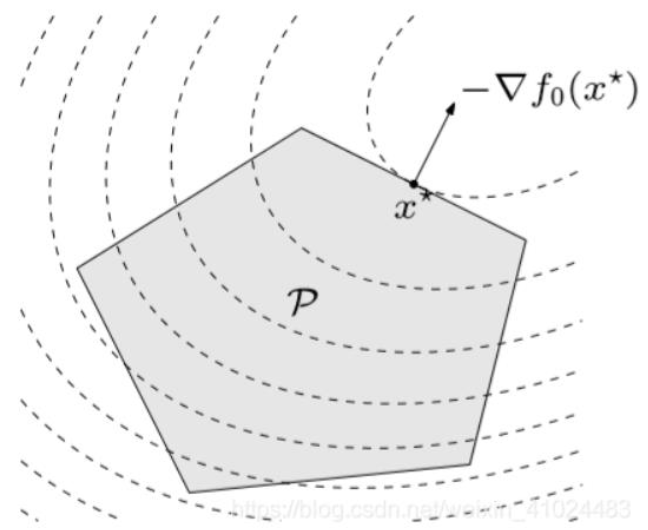

与线性规划不同的是,目标函数的等高线变成了椭球面,如下图所示:

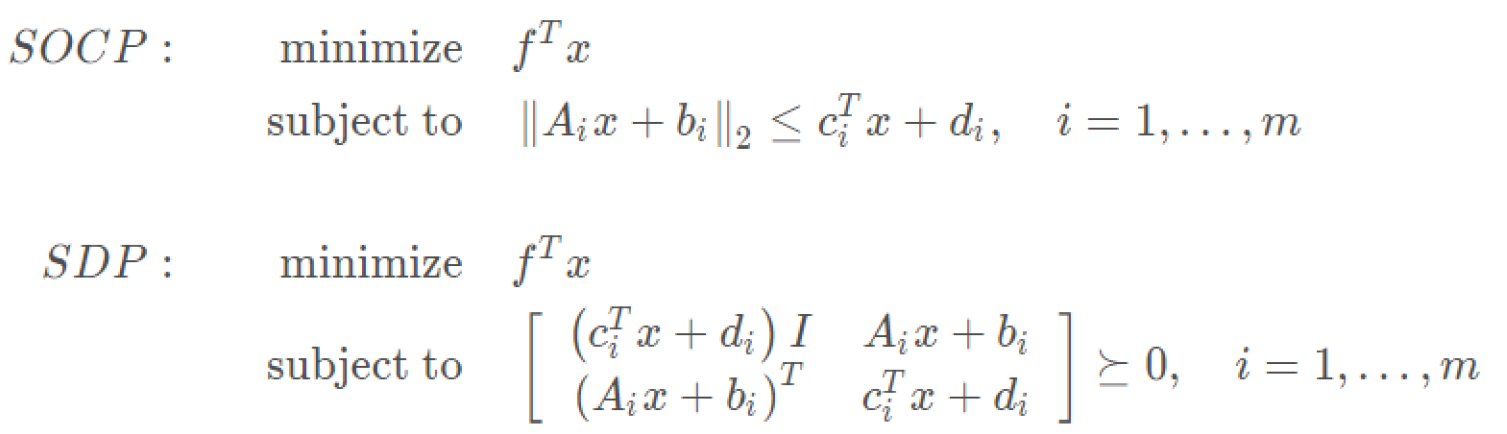

二阶锥规划(SOCP)可以转化为半正定规划(SDP)。其定义如下所示:

考虑凸优化问题:

假设 $x \in R^n$ ,定义域为 $\mathcal{D}$ ,最优解为 $p^{\star}$ 。

我们定义拉格朗日函数(Lagrangian) 为:

再取下确界得到拉格朗日对偶函数(Lagrange dual):

其性质有:

(1)$g(\lambda, \nu)$ 是凹函数 (不论原问题是否为凸问题)

(2)如果 $\lambda \succeq 0$ ,那么 $g(\lambda, \nu) \leq p^{\star}$ (对任意 $\lambda \succeq 0, \nu$ 都成立)

对偶问题

由于: $g(\lambda, \nu) \leq p^{\star}$

所以其对偶问题为:maximize $g(\lambda, \nu)$ subject to $\quad \lambda \succeq 0$

假如对偶问题的最优解为 $d^{\star}=\max g(\lambda, \nu)$ ,那么我们有 $p^{\star} \geq d^{\star}$ 。例:

原问题

Lagrangian

对偶函数

对偶问题的解

原问题的解

强对偶性

sup(上确界)和inf(下确界)。

这两个不等号必须要取到等号, 而第一个不等号取等条件应为:

第二个不等号取等条件为:

同时,由于 $x^{\star}, \lambda^{\star}, \nu^{\star}$ 还必须位于定义域内,需要满足约束条件 KKT 条件

(1)原始约束 $f_i(x) \leq 0, i=1, \ldots, m, \quad h_i(x)=0, i=1, \ldots, p$

(2)对偶约束 $\lambda \succeq 0$

(3)互补性条件(complementary slackness) $\lambda_i f_i(x)=0, i=1, \ldots, m$

(4)梯度条件

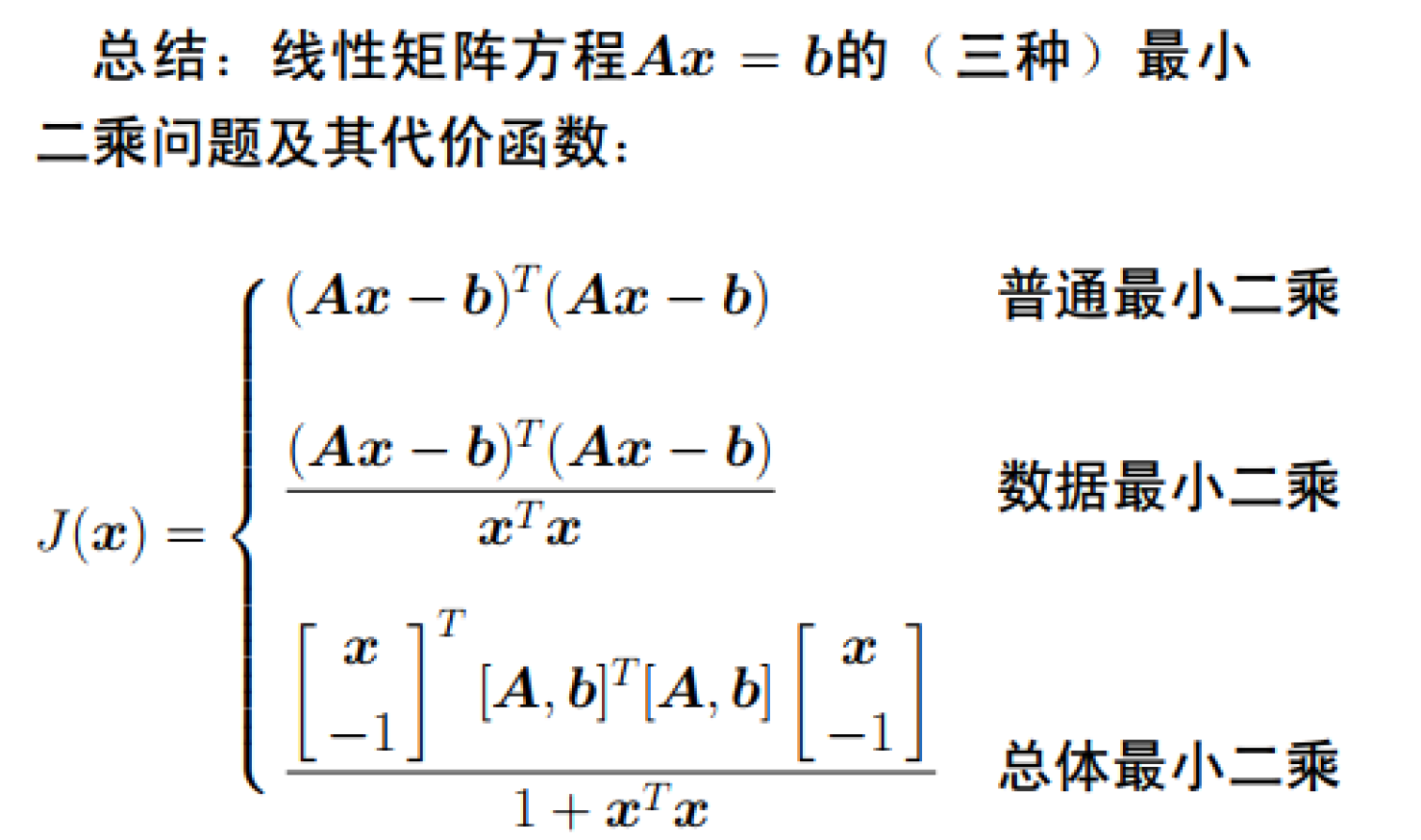

0x06 最小二乘

问题:求最佳解 $\boldsymbol{x}^*$,使得对应的方程两边的误差向量的某种范数最小化。

p=1,称为最小绝对偏差(LAD)问题;p=2,称为线性最小二乘问题(又分为普通最小二乘、数据最小二乘、总体最小二乘);p=无穷,称为最小最大问题。

在条件 $\boldsymbol{A} \boldsymbol{x}=\boldsymbol{b}+\Delta \boldsymbol{b}$ 约束下,$\min _{\boldsymbol{x}, \Delta \boldsymbol{b}}|\Delta \boldsymbol{b}|$

求代价函数 $\phi(\boldsymbol{x})=|\Delta \boldsymbol{b}|_2^2=|\boldsymbol{A} \boldsymbol{x}-\boldsymbol{b}|_2^2$ 相对于 $x$ 的梯度,并令其结果等于零向量,则有:

即解 $x$ 必然满足:

当 $m \times n$ 矩阵 $\boldsymbol{A}$ 具有不同的秩时,该方程的解分两种不同情况。

(1)$\operatorname{rank}(\boldsymbol{A})=n$

此时 $\boldsymbol{A}^{\mathrm{T}} \boldsymbol{A}$ 非奇异,所以方程有唯一的解:

(2)$ \operatorname{rank}(\boldsymbol{A})<n$

此时,方程 $A x=b$ 存在无穷多个解。显而易见,虽然数据向量 $b$ 可以提供有关 $A x$ 的某些信 息,但是却无法区别对应于相同 $\boldsymbol{A x}$ 值的各个不同的未知参数向量 $x$ 。因此,称这样的参数向量是不可辨识的。

Gauss-Markov定理

式中,$m \times n$ 矩阵 $\boldsymbol{A}$ 和 $n \times 1$ 向量 $\boldsymbol{\theta}$ 分别为常数矩阵和未知常数向量;$b$ 为 $m \times 1$ 向量,它存在随机误差向量 $e=$ $\left[e_1, e_2, \cdots, e_m\right]^{\mathrm{T}}$ 。令

则当且仅当 $\operatorname{rank}(\boldsymbol{A})=n$ 时,$n \times 1$ 参数向量 $\boldsymbol{\theta}$ 的最优无偏解 $\hat{\theta}$ 存在,且为:

其方差:

其中 $\tilde{\theta}$ 是矩阵方程 $\boldsymbol{A} \theta=b+e$ 的任意其他解。

定理证明:

(1)由假设条件 $\mathrm{E}{\boldsymbol{e}}=0$ 立即有:

利用已知条件 $\operatorname{cov}(\boldsymbol{e})=\mathrm{E}\left{\boldsymbol{e} \boldsymbol{e}^{\mathrm{H}}\right}=\sigma^2 \boldsymbol{I}$,并注意到 $\boldsymbol{A} \boldsymbol{\theta}$ 与误差向量 $e$ 统计不相关,又有:

由于 $\operatorname{rank}(\boldsymbol{A})=n$, 即 $\boldsymbol{A}^{\mathrm{H}} \boldsymbol{A}$ 非奇异,因此:

即最小二乘解 $\hat{\boldsymbol{\theta}}=\left(\boldsymbol{A}^{\mathrm{H}} \boldsymbol{A}\right)^{-1} \boldsymbol{A}^{\mathrm{H}} \boldsymbol{b}$ 是矩阵方程 $\boldsymbol{A} \boldsymbol{\theta}=\boldsymbol{b}+e$ 的无偏解。

(2)下面证明其有最小方差,省略。

Tikhonov正则化

针对上述(2)$\operatorname{rank}(\boldsymbol{A})<n$ 的情况,可以变成:

意思是让变量$x$最小,且误差最小。

数据最小二乘

将上述正则化改变一下,就变成:$\quad(\mathbf{A}+\mathbf{E}) \mathbf{x}=\mathbf{b}$

其对应的Lagrangian函数为:

由 $\frac{\partial L(\boldsymbol{x})}{\partial \boldsymbol{E}}=0$ 立即有 $\boldsymbol{E}=-\boldsymbol{\lambda} \boldsymbol{x}^T$, 再代入到 $(\boldsymbol{A}+\boldsymbol{E}) \boldsymbol{x}=\boldsymbol{b}$,得 $\lambda=\frac{\boldsymbol{A} \boldsymbol{x}-\boldsymbol{b}}{\boldsymbol{x}^T \boldsymbol{x}}$ 。由此得代价函数:

总体最小二乘(TLS)

与数据最小二乘做对比,可以得到:

总结一下:

总体最小二乘问题可以归结为:求一个具有最小范数的扰动矩阵 $\boldsymbol{D} \in \mathbb{C}^{m \times(n+1)}$,使得 $\boldsymbol{B}+\boldsymbol{D}$ 是非满秩的(如果满秩,则只有平凡解 $\boldsymbol{z}=0$ )。

(1)矩阵 $\boldsymbol{B}$ 的奇异值 $\sigman$ 明显比 $\sigma{n+1}$ 大,即最小的奇异值只有一个。

Lagrange乘数法,令目标函数:

的共轭梯度向量等于零向量,得:

因此,总体最小二乘解 $z$ 是与 $B$ 的最小奇异值 $\sqrt{\lambda}=$ $\sigma_{n+1}$ 对应的右奇异向量,即:

(2)矩阵B的最小奇异值多重(最后面若干个奇异值重复或非常接近)。

与这些小奇异值对应的任一右奇异向量 $\boldsymbol{v}_i$ 都给出一组总体最小二乘解。

例题1:以二维为例。对给定的一组带噪(误 差 ) 的观测数据点 $\left(x_1, y_1\right),\left(x_2, y_2\right), \cdots,\left(x_n, y_n\right)$,现希望拟合一直线 $a x+b y-c=0$,使得各数据点到该直线的距离平方和为最小。

解:

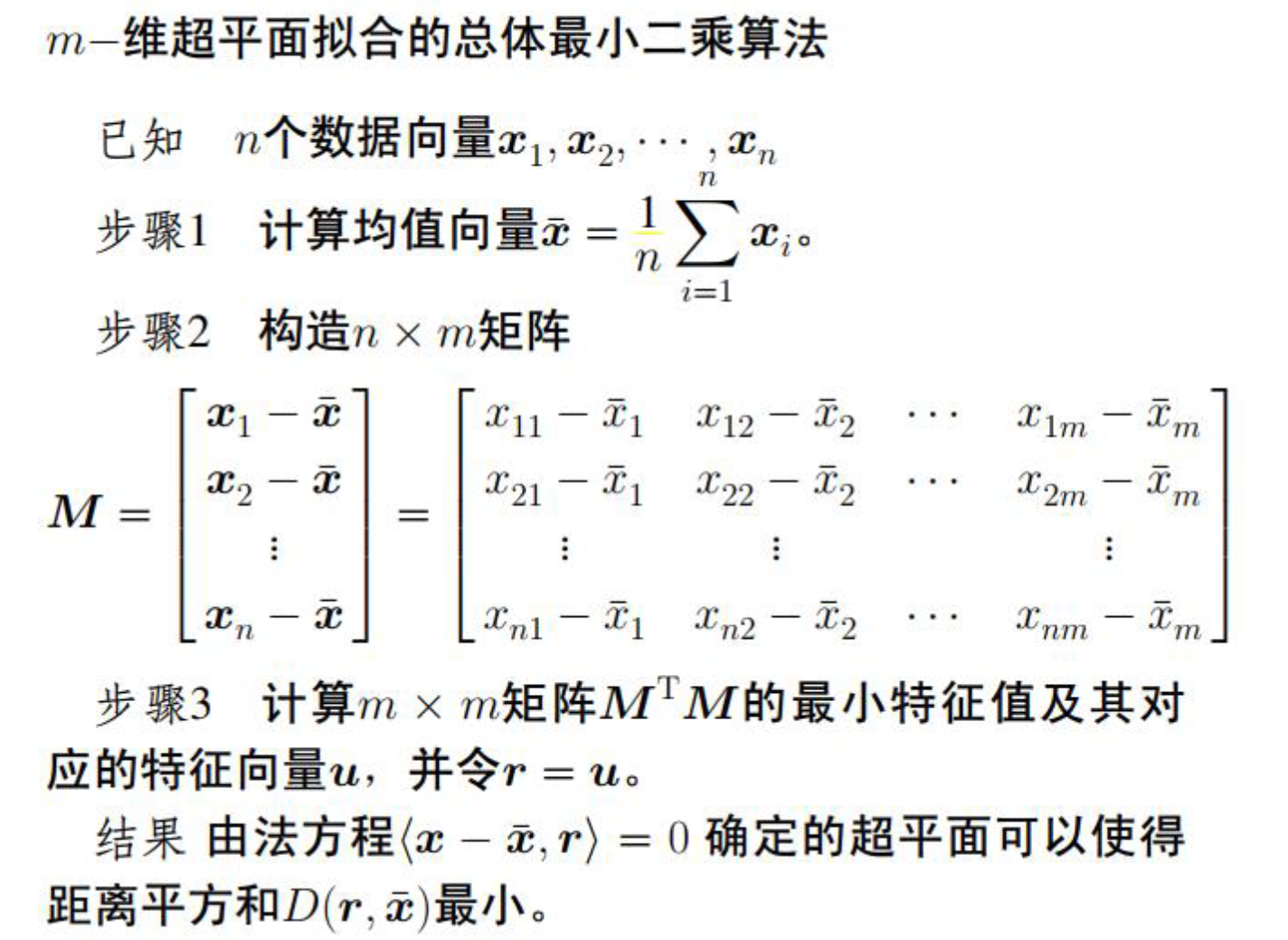

考虑让拟合直线通过已知n个数据点的中心:

若将 $c=a \bar{x}+b \bar{y}$ 代入,则直线方程为:

从而 $n$ 个已知数据点到直线 $a(x-\bar{x})+b(y-\bar{y})=0$ 的距离平方和为:

定理:若 $2 \times 1$ 法向量 $\boldsymbol{t}$ 取作与 $2 \times 2$ 矩阵 $\boldsymbol{M}^{\mathrm{T}} \boldsymbol{M}$ 的最小特征值 $\sigma_2^2$ 对应的特征向量,则距离平方和 $D(a, b, \bar{x}, \bar{y})$ 取最小值 $\sigma_2^2$ 。

因此,可以得出总体最小二乘拟合的算法:

约束总体最小二乘(CTLS)

TLS(总体最小二乘)为:求Frobenius范数最小的扰动矩阵 $D$ 使得

约束总体最小二乘(CTLS: constrained total least squares),将扰动矩阵约束为:

其中 $\boldsymbol{G}1, \cdots, \boldsymbol{G}{L+1}$ 已知,则 $\min |\boldsymbol{D}|_F$ 等价于 $\min |\boldsymbol{u}|_2$ 。

正式描述一下CTLS问题:

定理:

令

则约束总体最小二乘的解向量就是满足下列函数极小化的变量x:

其中 $\boldsymbol{W}_x^{\dagger}=\left(\boldsymbol{W}_x^{\mathrm{H}} \boldsymbol{W}_x\right)^{-1} \boldsymbol{W}_x^{\mathrm{H}}$ 是 $\boldsymbol{W}_x$ 的伪逆矩阵。

证明略。

总结

(1)普通最小二乘(OLS)。假定仅向量b有误差e,且每一个误差元素服从零均值、等方差的独立高斯分布。代价函数:

OLS准则:使方程两边的误差平方和最小。

(2)数据最小二乘(DLS)。假定仅数据矩阵A有误差,且每一个误差元素服从零均值、等方差的独立高斯分布,则x的最优解为:

(3)总体最小二乘(TLS)。假定数据矩阵A和向量b分别有误差矩阵D和误差向量e,并且每一个误差元素都服从零均值等方差的高斯分布,则x的解由优化问题:

0x07 特征分析

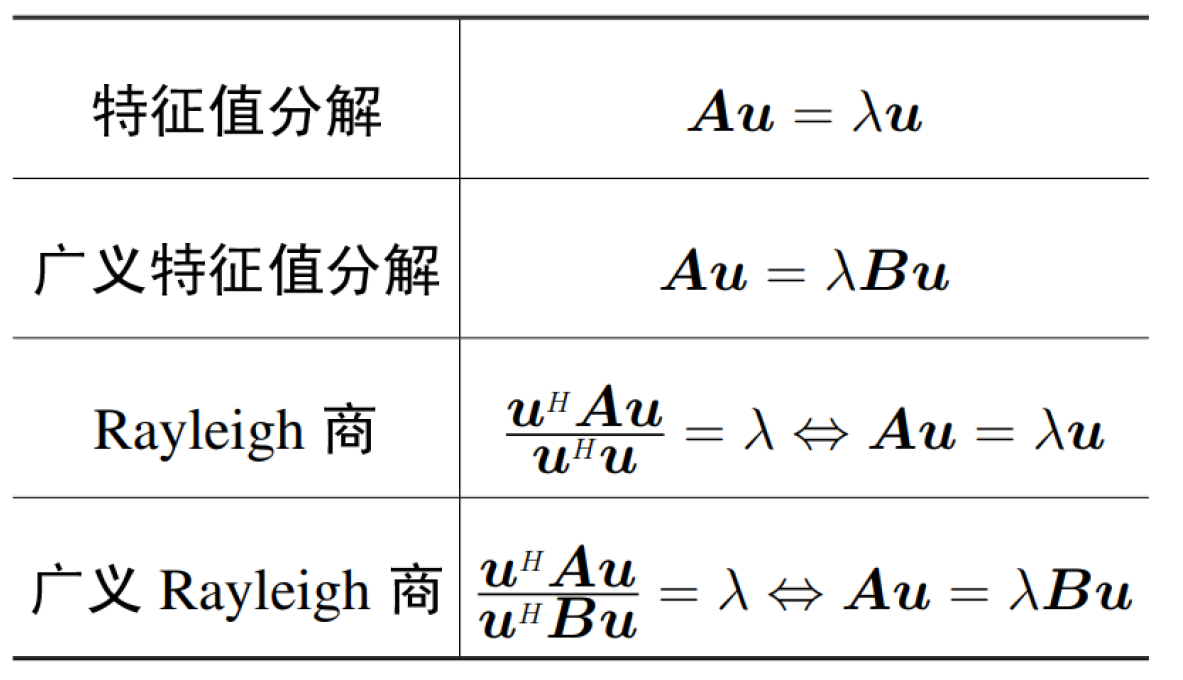

满足

的标量 $\lambda$ 和非零向量 $\boldsymbol{u}$ 分别称为矩阵束(矩阵对 $(\boldsymbol{A}, \boldsymbol{B})$ 的广义特征值)和广义特征向量。

广义特征值的定义:

其性质如下:

(1)若矩阵A和B互换,则广义特征值将变为其倒数,但广义特征向量保持不变。

(2)若B非奇异,则广义特征值分解简化为标准的特征值分解:

(3)若A和B均为实对称的正定矩阵,则广义特征值一定是正的。

(4)如果 $\boldsymbol{A}$ 奇异, 则 $\lambda=0$ 必定是一个广义特征值。

等价矩阵束: 所有广义特征值相同的两个矩阵束称为等价矩阵束。

若 $\boldsymbol{X}$ 和 $\boldsymbol{Y}$ 是两个非奇异矩阵,则 $(\boldsymbol{X} \boldsymbol{A} \boldsymbol{Y}$, $X \boldsymbol{B} \boldsymbol{Y})$ 和 $(\boldsymbol{A}, \boldsymbol{B})$ 是两个等价的矩阵束。

求广义特征值的标准方法为最小二乘方法,其总体最小二乘方法如下:

令 $\boldsymbol{A}$ 的奇异值分解为:

式中,$\boldsymbol{\Sigma}_1$ 由 $p$ 个主奇异值组成。

在不改变广义特征值的条件下,可以用 $\boldsymbol{U}_1^H$ 左乘和用 $\boldsymbol{V}_1$ 右乘矩阵 $\boldsymbol{A}-\gamma \boldsymbol{B}$,得到:

现在,原较大维数的矩阵束 $(\boldsymbol{A}, \boldsymbol{B})$ 的广义特征值问题便变成了较小维数 $(p \times p)$ 的矩阵束 $\left(\boldsymbol{\Sigma}_1, \boldsymbol{U}_1^{\mathrm{H}} \boldsymbol{B} \boldsymbol{V}_1\right)$ 的广义特征值问题。这一方法称为广义特征值分解的总体最小二乘方法。

广义特征值应用1

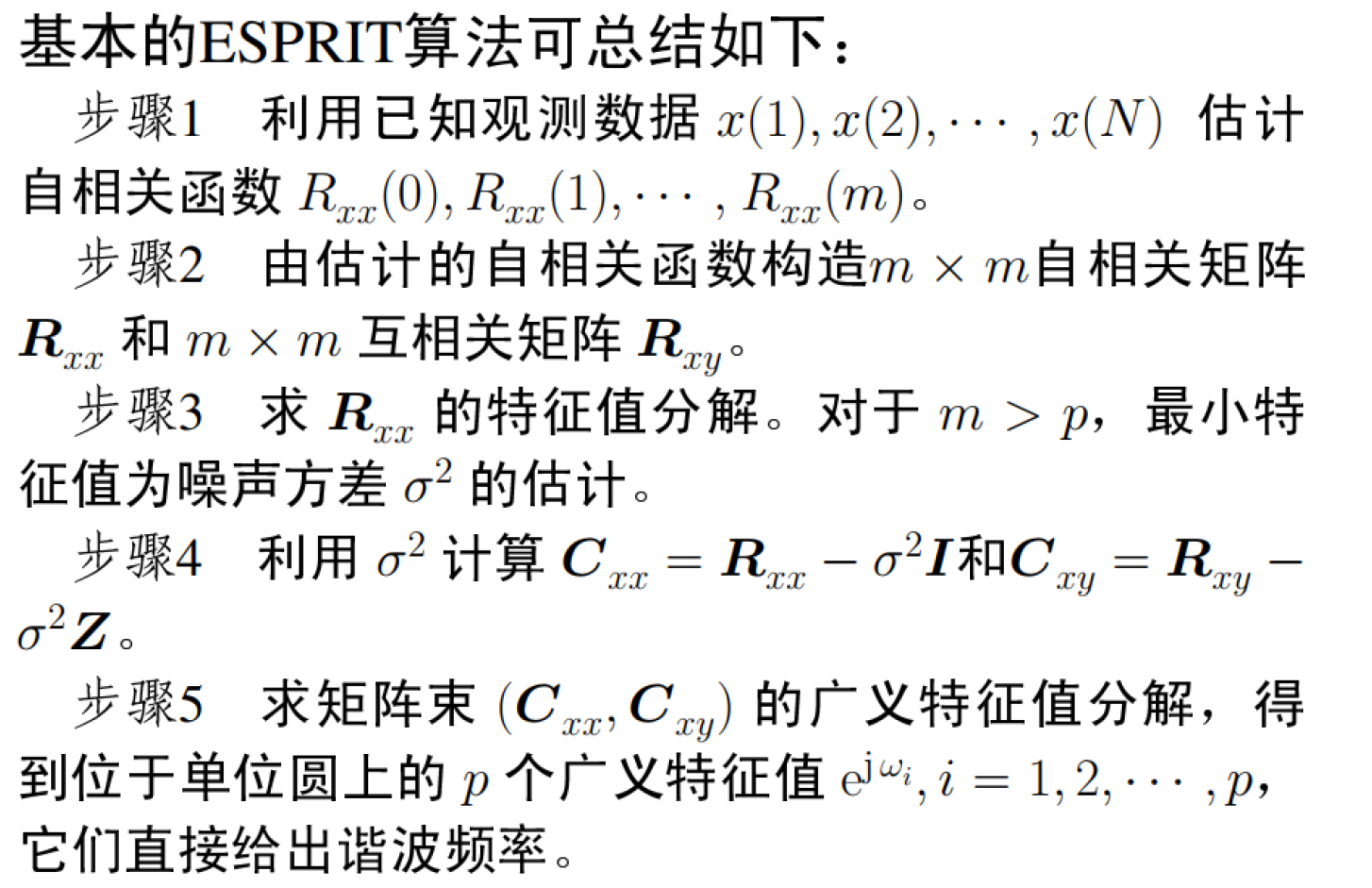

借助旋转不变技术估计信号参数(ESPRIT)

白噪声中的 $p$ 个谐波信号:

其中,$s_i$ 和 $\omega_i \in(-\pi, \pi)$ 分别为第 $i$ 个谐波信号的复幅值和频率。

定义一个新的过程 $y(n) \stackrel{\text { def }}{=} x(n+1)$ 。选择 $m>$ $p$,并引入以下 $m \times 1$ 维向量:

于是,有

式中:

注意,$\boldsymbol{\Phi}$ 是一酉矩阵,即有 $\boldsymbol{\Phi}^{\mathrm{H}} \boldsymbol{\Phi}=\boldsymbol{\Phi} \boldsymbol{\Phi}^{\mathrm{H}}=\boldsymbol{I}$,它将空间的向量 $\boldsymbol{x}(n)$ 和 $\boldsymbol{y}(n)$ 联系在一起; 矩阵 $\boldsymbol{A}$ 是一个 $m \times$ $p$ 维 Vandermonde矩阵。由于 $\boldsymbol{y}(n)=\boldsymbol{x}(n+1)$,故 $\boldsymbol{y}(n)$ 可以看作是 $\boldsymbol{x}(n)$ 的平移结果。鉴于此,矩阵 $\boldsymbol{\Phi}$ 被称作旋转算符,因为平移是最简单的旋转。

观测向量 $\boldsymbol{x}(n)$ 的自相关矩阵为:

式中 $\boldsymbol{P}=\mathrm{E}\left{\boldsymbol{s}(n) \boldsymbol{s}^{\mathrm{H}}(n)\right}$ 是信号向量的相关矩阵。若各信号不相关,则 $\boldsymbol{P}=\operatorname{diag}\left(\mathrm{E}\left{\left|s_1\right|^2\right}, \cdots, \mathrm{E}\left{\left|s_p\right|^2\right}\right)$ 是一 个 $p \times p$ 对角矩阵,其对角线上的元素为各信号的功率。

向量 $\boldsymbol{x}(n)$ 和 $\boldsymbol{y}(n)$ 的互相关矩阵为:

式中,$\sigma^2 \boldsymbol{Z}=\mathrm{E}\left{\boldsymbol{w}(n) \boldsymbol{w}^{\mathrm{H}}(n+1)\right}$ 。

对 $\boldsymbol{R}{x x}$ 作特征值分解,可以得到其最小特征值 $\lambda{\min }=\sigma^2$ 。构造一对新的矩阵:

$\left(\boldsymbol{C}{x x}, \boldsymbol{C}{x y}\right)$ 组成矩阵束。

由于 $A$ 满列秩和 $P$ 非奇异,所以从矩阵秩的角度,上式可以写作:

当 $\gamma \neq \omegai, i=1,2, \cdots, p$ 时,矩阵 $(\boldsymbol{I}-\gamma \boldsymbol{\Phi})$ 是非奇异的,而当 $\gamma=\mathrm{e}^{\mathrm{j} \omega_i }$ 时,由于 $\gamma \mathrm{e}^{-\mathrm{j} \omega_i}=1$,所以矩阵 $(\boldsymbol{I}-\gamma \boldsymbol{\Phi})$ 奇异,即秩亏缺。这说明,$\mathrm{e}^{j \omega_i}, i=1,2,…,p$都是矩阵束 $\left(\boldsymbol{C}{x r}, \boldsymbol{C}_{x u}\right)$ 的广义特征值。

特征分析的内涵

定义:若非零向量 $u$ 作为线性算子 $\mathcal{L}$ 的输入时, 所产生的输出与输入只相差一个常数因子 $\lambda$

则称向量 $\boldsymbol{u}$ 为线性算子 $\mathcal{L}$ 的特征向量,而该标量 $\lambda$ 为 $\mathcal{L}$ 的特征值(eigen-value)。例如:

由此可见,作为线性变换下方向不变的特征向量,可以看作表征系统 $A$ 特征性质的向量,实际刻画了该变换固有的特性。而在特征向量上的增益 $\lambda$ 即为特征值。在这个意义上,特征向量也称为本征向量(eigen-vector)。

推广:若非零向量 $u$ 同时作为线性算子 $\mathcal{L}_A$ 和 $\mathcal{L}_B$ 的输入时,所产生的输出只相差一个常数因子 $\lambda$。

则称向量 $\boldsymbol{u}$ 为线性算子 $\mathcal{L}_A$ 和 $\mathcal{L}_B$ ( 广义特征系统) 的广义特征向量,而该标量 $\lambda$ 为 $\mathcal{L}_A$ 和 $\mathcal{L}_B$ 与 $\boldsymbol{u}$ 对应的的广义特征值。

例题1:线性时不变系统的特征模式。考虑线性时不变系统 $h(k)$,其传递函数为 $H\left(e^{j \omega}\right)=\sum_{k=-\infty}^{\infty} h(k) e^{-j \omega k}$ 。 以复指数函数或谐波信号 $e^{j \omega n}$ 作为输入,有:

令 $n=0,1, \cdots, N-1$,则有:

这表明,谐波信号向量 $\boldsymbol{w}(\omega)=\left[1, e^{j \omega}, \cdots, e^{j \omega(N-1)}\right]^{\mathrm{T}}$ 是线性时不变系统的特征向量,而系统传递函数 $H\left(e^{j \omega}\right)$ 是 与 $\boldsymbol{w}(\omega)$ 对应的特征值。

Rayleigh商

经常遇到求解如:

的Hermite矩阵的二次型函数的商的极值问题。

Hermitian 矩阵 $\boldsymbol{A} \in \mathbb{C}^{n \times n}$ 的 Rayleigh 商或 Rayleigh-Ritz 比 $R(\boldsymbol{x})$ 是一个标量,定义为:

其中,$x$ 是待选择的向量,其目的是使 Rayleigh 商最大化或者最小化。

由于$R(\alpha \boldsymbol{x})=R(\boldsymbol{x}),(\alpha \neq 0)$,所以在考虑 $R(\boldsymbol{x})$ 的极值时,可以只限定在单位球面 $|\boldsymbol{x}|_2=1$ 上讨论。

Rayleigh商的性质:

(1)齐次性: 若 $\alpha$ 和 $\beta$ 为标量,则:

(2)平移不变性:

(3)正交性:

(4)有界性(Rayleigh-Ritz定理)。令 $\boldsymbol{A} \in \mathbb{C}^{n \times n}$ 是 Hermitian 的,并令 $\boldsymbol{A}$ 的特征值按递增次序排列:$\lambda{\min }=\lambda_1 \leqslant \lambda_2 \leqslant \cdots \leqslant \lambda{n-1} \leqslant \lambdan=\lambda{\max }$。

那么有:

$\max {\boldsymbol{x} \neq \mathbf{0}} \frac{\boldsymbol{x}^{\mathrm{H}} \boldsymbol{A} \boldsymbol{x}}{\boldsymbol{x}^{\mathrm{H}} \boldsymbol{x}}=\max {x^{\mathrm{H}} x=1} \frac{\boldsymbol{x}^{\mathrm{H}} \boldsymbol{A} \boldsymbol{x}}{\boldsymbol{x}^{\mathrm{H}} \boldsymbol{x}}=\lambda{\max }, \quad$ 若 $\boldsymbol{A} \boldsymbol{x}=\lambda{\max } \boldsymbol{x}$

更一般地,矩阵 $\boldsymbol{A}$ 的所有特征向量和特征值分别称为 Rayleigh 商 $R(\boldsymbol{x})$ 的临界点(critical point) 和临界 值(critical value)。

(5)最小残差。对于所有 $\boldsymbol{x} \neq 0$ 和所有标量 $\mu$,恒有:

Rayleigh商应用:总体最小二乘拟合

取法向量为单位长度向量,即 $|\boldsymbol{t}|_2=1$,则:

这是典型的 Rayleigh 商形式。因此,法向量 $t$ 是与矩阵 $M^{\mathrm{T}} M$ 的最小特征值对应的特征向量。

广义Rayleigh商

定义:令 $\boldsymbol{A}$ 和 $\boldsymbol{B}$ 均为 $n \times n$ 维 Hermitian 矩阵, 且 $\boldsymbol{B}$ 正定。矩阵束 $(\boldsymbol{A}, \boldsymbol{B})$ 的广义 Rayleigh 商或广义 Rayleigh-Ritz 比 $R(\boldsymbol{x})$ 是一个标量(函数)。

其中,x是待选择的向量,其目的是使广义Rayleigh 商最大化或者最小化。

矩阵束 $(\boldsymbol{A}, \boldsymbol{B})$ 的广义 Rayleigh 商等价为矩阵乘积 $\left(\boldsymbol{B}^{-1 / 2}\right)^{\mathrm{H}} \boldsymbol{A}\left(\boldsymbol{B}^{-1 / 2}\right)$ 的 Rayleigh 商。矩阵乘积 $\left(\boldsymbol{B}^{-1 / 2}\right)^{\mathrm{H}} \boldsymbol{A}\left(\boldsymbol{B}^{-1 / 2}\right)$ 的特征值分解与 $B^{-1} A$ 的特征值分解等价,而前者又与矩阵束 $(\boldsymbol{A}, \boldsymbol{B})$ 的广义特征值分解等价。因此,有:

即是说,欲使广义 Rayleigh 商最大化,向量 $x$ 必须选取与矩阵束 $(\boldsymbol{A}, \boldsymbol{B})$ 最大广义特征值对应的特征向量。

特征值分解与Rayleigh商的关系:

Jordan标准型

定理1:设 $\boldsymbol{A} \in \mathbb{C}^{n \times n}$, 则 $\boldsymbol{A}$ 酉相似于对角矩阵的充要条件是 $A$ 为正规矩阵 $\left(\boldsymbol{A}^{\mathrm{H}} \boldsymbol{A}=\boldsymbol{A} \boldsymbol{A}^{\mathrm{H}}\right)$ 。

证明:

(1)必要性。设酉矩阵 $\boldsymbol{U}$ 使得 $\boldsymbol{U}^{\mathrm{H}} \boldsymbol{A} \boldsymbol{U}=\boldsymbol{\Lambda}$ (对角矩阵),则有:

即A为正规矩阵。

(2)充分性。设A是充分矩阵,由Schur引理可知,存在酉矩阵U满足:

根据的 $B$ 上三角特性, 比较上式两端矩阵的元素,可知B是对角阵。

定理2:$\boldsymbol{A} \in \mathbb{C}^{n \times n}$ 相似于对角矩阵的充要条件是 $\boldsymbol{A}$ 有 $n$ 个 线性无关的特征向量, 或 $A$ 有完备的特征向量系。

定理3: 对于任一矩阵 $\boldsymbol{A} \in \mathbb{C}^{n \times n}$, 均存在可逆矩阵 $\boldsymbol{P}$, 使其相似于如下形式的块对角矩阵 (Jordan标准形 ) :

其中 $\boldsymbol{J}i\left(\lambda_i\right)=\left[\begin{array}{cccc}\lambda_i & 1 & & \ & \lambda_i & \ddots & \ & & \ddots & 1 \ & & & \lambda_i\end{array}\right]{m_i \times m_i}$;

为与 $A$的特征值 $\lambda_i(i=1, \cdots, s)$ 对应的Jordan块矩阵。

0x08 特征值分解

(1)称 $\boldsymbol{A}$ 的特征值 $\lambda$ 具有代数多重度 (algebraic multiplicity) $\mu$,若 $\lambda$ 是特征多项式 $\operatorname{det}(\boldsymbol{A}-z \boldsymbol{I})=$ 0 的 $\mu$ 重根。

(2)称 $\boldsymbol{A}$ 的特征值 $\lambda$ 具有几何多重度(geometric multiplicity) $\gamma$,若与 $\lambda$ 对应的线性无关特征向 量 $\boldsymbol{u}$ 的个数为 $\gamma$ 。换言之,几何多重度 $\gamma$ 是特征空间 $\operatorname{Null}(\boldsymbol{A}-\lambda \boldsymbol{I})$ 的维数。

特征值的性质:

(1)矩阵 $\boldsymbol{A}$ 奇异,当且仅当至少有一个特征值 $\lambda=0$ 。

(2)矩阵 $\boldsymbol{A}$ 和 $\boldsymbol{A}^{\mathrm{T}}$ 具有相同的特征值。

(3)$\lambda^k$ 是矩阵 $\boldsymbol{A}^k$ 的特征值。

(4)若 $\boldsymbol{A}$ 非奇异,则 $\boldsymbol{A}^{-1}$ 具有特征值 $1 / \lambda$ 。

(5)矩阵 $\boldsymbol{A}+\sigma^2 \boldsymbol{I}$ 的特征值为 $\lambda+\sigma^2$ 。

(6)若 $\boldsymbol{A}$ 是实对称矩阵或Hermitian矩阵,则其所有特征值都是实数。

(7)对角矩阵与三角矩阵的特征值是其对角元素。

(8)若 $\lambda$ 是 $\boldsymbol{A}$ 的特征值,则 $\lambda$ 也是 $\boldsymbol{A}^{\mathrm{T}}$ 的特征值。若 $\lambda$ 是 $\boldsymbol{A}$ 的特征值,则 $\lambda^*$ 是 $\boldsymbol{A}^{\mathrm{H}}$ 的特征值。若 $\lambda$ 是 $\boldsymbol{A}$ 的特征值,则 $\lambda+\sigma^2$ 是 $\boldsymbol{A}+\sigma^2 \boldsymbol{I}$ 的特征值。若 $\lambda$ 是矩阵 $\boldsymbol{A}$ 的特征值,则 $1 / \lambda$ 是逆矩阵 $\boldsymbol{A}^{-1}$ 的特征值。

(9)幂等矩阵 $\boldsymbol{A}^2=\boldsymbol{A}$ 的所有特征值取 0 或 1。若 $A$ 是实正交矩阵, 则其所有特征值为 1 或者 -1 。

(10)若 $A$ 奇异,则它至少有一个特征值为 0 。

(11)特征值与迹的关系:矩阵 $\boldsymbol{A}$ 的特征值之和等于该矩阵的迹,即 $\sum_{i=1}^n \lambda_i=\operatorname{tr}(\boldsymbol{A})$ 。

(12)与不同特征值 $\lambda_1, \lambda_2, \cdots, \lambda_n$ 对应的非零特征向量 $\boldsymbol{u}_1, \boldsymbol{u}_2, \cdots, \boldsymbol{u}_n$ 线性无关。

(13)矩阵 $\boldsymbol{A}$ 所有特征值的乘积等于该矩阵的行列式,即 $\prod_{i=1}^n \lambda_i=$ $\operatorname{det}(\boldsymbol{A})=|\boldsymbol{A}|$。

(14)一 个Hermitian矩阵 $\boldsymbol{A}$ 是正定(或半正定)的,当且仅当它的特征值是正(或者非负)的。

(15)若 $\boldsymbol{A}$ 的特征值不相同,则一定可以找到一个相似矩阵 $S^{-1} \boldsymbol{A} \boldsymbol{S}=D$ (对角矩阵),其对角元素即是矩阵 $A$ 的特征值。

(16)相似矩阵具有相同的特征值。

(17)若矩阵 $\boldsymbol{A}$ 的特征值为 $\lambda$,则矩阵多项式 $f(\boldsymbol{A})=\boldsymbol{A}^n+c1 \boldsymbol{A}^{n-1}+\cdots+c{n-1} \boldsymbol{A}+cn \boldsymbol{I}$ 的特征值为 $f(\lambda)=\lambda^n+c_1 \lambda^{n-1}+\cdots+c{n-1} \lambda+c_n$ 。

(18)若矩阵 $A$ 的特征值为 $\lambda$,则矩阵指数函数 $\mathrm{e}^A$ 的特征值为 $\mathrm{e}^\lambda$ 。

SVD(奇异值分解)与EVD(特征值分解)。他们的比较:

(1)SVD可以用于任意矩阵的分解,包括非方阵和奇异矩阵,而EVD只能用于方阵的分解。

(2)同一个正方矩阵的奇异值和特征值之间没有内在的关系,但是 $m \times n$ 矩阵 $\boldsymbol{A}$ 的非零奇异值是 $n \times n$ Hermitian矩阵 $\boldsymbol{A}^{\mathrm{H}} \boldsymbol{A}$ 或 $m \times m$ Hermitian矩阵 $\boldsymbol{A} \boldsymbol{A}^{\mathrm{H}}$ 的非零特征值的正平方根。

(3)对于同一个 $n \times n$ 非Hermitian矩阵 $\boldsymbol{A}$,它 的(左和右)奇异向量与(左和右)特征向量之间没有内在的关系。然而,矩阵 $\boldsymbol{A} \in C^{m \times n}$ 的左奇异向量 $\boldsymbol{u}_i$ 是 $m \times m$ Hermitian矩阵 $\boldsymbol{A} \boldsymbol{A}^{\mathrm{H}}$ 的特征向量,因为

Hemitian矩阵的特征值分解

Hemitian矩阵的特征如下:

(1)Hermitian 矩阵 $\boldsymbol{A}$ 的特征值一定是实的。

(2)令 $(\lambda, \boldsymbol{u})$ 是 Hermitian 矩阵 $\boldsymbol{A}$ 的特征对。若 $\boldsymbol{A}$ 可逆, 则 $\left(\frac{1}{\lambda}, \boldsymbol{u}\right)$ 是逆矩阵 $\boldsymbol{A}^{-1}$ 的特征对。

(3)Hermitian矩阵的所有特征向量线性无关, 并且相互正交。即是说, 特征矩阵 $U=$ $\left[\boldsymbol{u}_1, \boldsymbol{u}_2, \cdots, \boldsymbol{u}_n\right]$ 是酉矩阵, 满足 $\boldsymbol{U}^{-1}=\boldsymbol{U}^{\mathrm{H}}$ 。

Hermitian 矩阵的特征值分解的常见公式:$\boldsymbol{A}=\boldsymbol{U} \boldsymbol{\Sigma} \boldsymbol{U}^H$

可对角化定理

一个 $n \times n$ 实矩阵 $\boldsymbol{A}$ 是可对角化的,当且仅当 $\boldsymbol{A}$ 具有 $n$ 个线性无关的特征向量。

可对角化定理:若矩阵 $\boldsymbol{A} \in C^{n \times n}$ 的特征值 $\lambdak$ 具有多重度 $m_k, k=1, \cdots, p$,并且 $\sum{k=1}^p m_k=$ $n$,则矩阵 $\boldsymbol{A}$ 具有 $n$ 个线性无关的特征向量,当且仅当 $\operatorname{rank}\left(\boldsymbol{A}-\lambda_k \boldsymbol{I}\right)=n-m_k, k=1,2, \cdots, p$ 。 此时,$\boldsymbol{A} \boldsymbol{U}=\boldsymbol{U} \boldsymbol{\Sigma}$ 中的矩阵 $\boldsymbol{U}$ 是非奇异的,而且 $\boldsymbol{A}$ 可对角化为 $\boldsymbol{U}^{-1} \boldsymbol{A} \boldsymbol{U}=\boldsymbol{\Sigma}$ 。

Cayley-Hamilton定理

若 $p(\boldsymbol{A})=pn \boldsymbol{A}^n+p{n-1} \boldsymbol{A}^{n-1}+\cdots+p_1 \boldsymbol{A}+p_0 \boldsymbol{I}=$ $\boldsymbol{O}$,则称

是使矩阵 $A$ 零化的多项式,简称零化多项式。

对于一个 $n \times n$ 矩阵 $\boldsymbol{A}$,令 $m$ 是使得幂 $\boldsymbol{I}$, $\boldsymbol{A}, \cdots, \boldsymbol{A}^m$ 线性相关的最小整数。于是,有方程式

式中,$\boldsymbol{A}^m$ 的系数不为零。多项式 $p(x)=pm x^m+$ $p{m-1} x^{m-1}+\cdots+p_1 x+p_0$ 称为矩阵 $\boldsymbol{A}$ 的最小多项式。

Cayley-Hamilton定理:每一个正方矩阵 $\boldsymbol{A}_{n \times n}$ 都满足其特征方程,即若特征多项式为:

则:

结论就是:特征多项式 $p(x)=\operatorname{det}(\boldsymbol{A}-x \boldsymbol{I})$ 是使矩阵 $\boldsymbol{A}_{n \times n}$ 零化的多项式。

Cayley-Hamilton定理应用1:计算逆矩阵

Cayley-Hamilton定理应用2:计算矩阵幂

(1)构造特征多项式

(2)计算特征方程 $p(x)=0$ 的 $n$ 个特征根即 特征值 $\lambda_1, \lambda_2, \cdots, \lambda_n$ 。

(3)得线性方程:

(4)计算矩阵幂:

例1:已知

计算 $\boldsymbol{A}^{731}$ 。

解:构造特征多项式:

令 $p(x)=0$, 求出 $\boldsymbol{A}$ 的特征值 $\lambda_1=0$ 和 $\lambda_2=2$ 。 将特征值代入式(3)得线性方程组

解之,得 $r_0=0$ 和 $r_1=2^{730}$ 。

计算矩阵幂,得:

迷你圆变换与离散Karhunen-Loeve 变换省略。

0x09 子空间

定义1:非空集合满足加法运算与数乘运算,则称 $\mathcal{V}$ 为数域 $\mathbb{K}$ 上的线性空间或向量空间,而 $\mathcal{V}$ 中所定义的加法及数乘运算统称为 $\mathcal{V}$ 的线性运算。

定义2:线性组合与线性表示(略)。

定义3:满足$\mathbf{0}=c_1 \boldsymbol{u}_1+c_2 \boldsymbol{u}_2+\cdots+c_m \boldsymbol{u}_m$,且系数$c_1, c_2, \cdots, c_m$不全为0,则称向量组$\boldsymbol{u}_1, \boldsymbol{u}_2, \cdots, \boldsymbol{u}_m$线性相关,否则线性无关。

定义4:线性空间 $\mathcal{V}$ 中线性无关向量组所含向量的最大个数称为 $\mathcal{V}$ 的维数。若 $n$ 是具有这个性质的正整数, 则记为 $\operatorname{dim} \mathcal{V}=n$。当 $n=\infty$ 时,称 $\mathcal{V}$ 为无限维线性空间。

定义5:若 $S=\left{\boldsymbol{u}_1, \cdots, \boldsymbol{u}_m\right}$ 是向量空间 $\mathcal{V}$ 的向量子集合,则 $\boldsymbol{u}_1, \cdots, \boldsymbol{u}_m$ 的所有线性组合的集合。如下所示:

称为由 $\boldsymbol{u}_1, \cdots, \boldsymbol{u}_m$ 张成的子空间。张成子空间 $\mathcal{W}$ 的每个向量称为 $\mathcal{W}$ 的生成 元 (generator),而所有生成元组成的集合 $\left{\boldsymbol{u}_1, \cdots, \boldsymbol{u}_m\right}$ 称为子空间的张成集(spanning set)。

张成集定理:若张成集中有一个变量是其他变量的线性组合,那么去掉它也可以构成相同的张成空间。相当于去掉冗余,去掉冗余之后,就有了张成基(尽可能小的张成集)。(1)基不是唯一的,有多种选择。(2)基的个数是固定的,等于子空间的维数。(3)零空间不可能作为基向量。

定义7:设 $U=\left{\boldsymbol{u}_1, \cdots, \boldsymbol{u}_m\right}$ 和 $V=\left{\boldsymbol{v}_1, \cdots, \boldsymbol{v}_m\right}$ 是 $m$ 维向量子空间 $\mathcal{W}$ 的两组不同的基。若:

其中,有:

称 $\boldsymbol{C}$ 为由基 $U$ 到基 $V$ 的过渡矩阵。向量子空间的任意向量都可以由基表示。

定理:坐标变换。设 $\boldsymbol{x} \in \mathcal{W}$ 在两个不同基 $U=\left{\boldsymbol{u}_1, \cdots, \boldsymbol{u}_m\right}$ 和 $V=\left{\boldsymbol{v}_1, \cdots, \boldsymbol{v}_m\right}$ 下的坐标分别为 $\xi_1, \xi_2, \cdots, \xi_m$ 和 $\eta_1, \eta_2, \cdots, \eta_m$,即:

则有:

定义8:子空间 $\mathcal{S}_1, \mathcal{S}_2, \cdots, \mathcal{S}_n$ 的交是各子空间共同拥有的所有向量组成的集合,表示为 $\mathcal{S}=\mathcal{S}_1 \cap \mathcal{S}_2 \cap \cdots \cap \mathcal{S}_n$。若多个子空间共同的唯一向量为零向量,即 $\mathcal{S}=$ $\mathcal{S}_1 \cap \mathcal{S}_2 \cap \cdots \cap \mathcal{S}_n={\mathbf{0}}$,则称子空间 $\mathcal{S}_1, \mathcal{S}_2, \cdots, \mathcal{S}_n$ 无交连(disjoint)。设 $\boldsymbol{x}_1 \in \mathcal{S}_1, \cdots, \boldsymbol{x}_n \in \mathcal{S}_n$,则所有 $\boldsymbol{x}_1+\cdots+\boldsymbol{x}_n$ 的元素集合称为空间 $\mathcal{S}_1, \mathcal{S}_2, \cdots, \mathcal{S}_n$ 的和 (并),即:

定义11:无交连子空间的和称为子空间的直和,并记作 $\mathcal{S}=\mathcal{S}_1 \oplus \cdots \oplus \mathcal{S}_n$ 。此时,每一个向量 $\boldsymbol{x} \in \mathcal{S}$ 具有唯一的分解表示 $\boldsymbol{x}=\boldsymbol{x}_1+\boldsymbol{x}_2+\cdots+\boldsymbol{x}_n$,其中,$\boldsymbol{x}_i \in \mathcal{S}_i$ 。

定理:维数公式。如果 $\mathcal{S}_1, \mathcal{S}_2$ 是数域 $\mathbb{K}$ 上的线性空间 $\mathcal{S}$ 的两个子空间,则:

证明看PPT Page13。

定义12(子空间正交):若一向量与子空间 $\mathcal{S}$ 内的所有向量都正交,则称该向量正交于子空间 $\mathcal{S}$ 。推而广之,称子空间 $\mathcal{S}1, \mathcal{S}_2, \cdots, \mathcal{S}_n$ 为正交子空间,记作 $\mathcal{S}_i \perp \mathcal{S}_j, i \neq$ $j$,若 $\forall \boldsymbol{x}_i \in \mathcal{S}_i, \boldsymbol{x}_j \in \mathcal{S}_j(i \neq j)$,恒有 $\boldsymbol{x}_i \perp \boldsymbol{x}{j^{\circ}}$ 。

定义13:与子空间 $\mathcal{S}$ 正交的所有向量的集合组成一个向量子空间,称为 $\mathcal{S}$ 的正交补 (orthogonal complement) 空间,记作 $\mathcal{S}^{\perp}$,即:

其性质有:

(1)$\operatorname{dim} \mathcal{S}+\operatorname{dim} \mathcal{S}^{\perp}=\operatorname{dim} \mathcal{V}$,$\mathcal{V}$是向量空间。

(2)子空间 $\mathcal{S}$ 在向量空间 $\mathcal{V}$ 的正交补空间 $\mathcal{S}^{\perp}$ 具有正 交和补充的双重涵义:

a)子空间 $\mathcal{S}^{\perp}$ 与 $\mathcal{S}$ 正交。

b)向量空间 $\mathcal{V}$ 是子空间 $\mathcal{S}$ 与 $\mathcal{S}^{\perp}$ 的直和,即 $\mathcal{V}=\mathcal{S} \oplus \mathcal{S}^{\perp}$ 。 这表明,向量空间 $\mathcal{V}$ 是由子空间 $\mathcal{S}$ 补充 $\mathcal{S}^{\perp}$ 而成。

(3)向量空间 $\mathcal{V}$ 中的每一个向量 $z$ 都可以唯一分解为子空间 $\mathcal{S}$ 的向量 $x$ 与正交补 $\mathcal{S}^{\perp}$ 的向量 $y$ 之和:

这一分解形式称为向量的正交分解。

定义14(不变子空间):一个子空间 $\mathcal{S} \subseteq \mathbb{C}^n$ 称为(相对于 ) $\boldsymbol{A}$ 不变的,若 $\boldsymbol{x} \in \mathcal{S} \Rightarrow \boldsymbol{A x} \in \mathcal{S}$ 。

例子:令 $n \times n$ 矩阵 $\boldsymbol{A}$ 的特征向量为 $\boldsymbol{u}_1, \cdots, \boldsymbol{u}_n$,且 $\mathcal{S}=$ $\operatorname{Span}\left(\boldsymbol{u}_1, \cdots, \boldsymbol{u}_n\right)$,则由 $\boldsymbol{A} \boldsymbol{u}_i=\lambda_i \boldsymbol{u}_i, i=1, \cdots, n$ 可知:

因此,由 $\boldsymbol{A}$ 的特征向量张成的子空间 $\mathcal{S}$ 是相对于 $A$ 不变的子空间。进一步地,由于:

其中,$\operatorname{Null}(\boldsymbol{A}-\lambda \boldsymbol{I}) $指的是使$\boldsymbol{A}-\lambda \boldsymbol{I}$行列式等于0的子空间。即零空间 $\operatorname{Null}(\boldsymbol{A}-\lambda \boldsymbol{I})$ 是相对于 $\boldsymbol{A}$ 不变的子空间,称其为矩阵 $A$ 与特征值 $\lambda$ 相对应的特征空间 (eigenspace ) 。

定义15(向量夹角):两个非零向量 $\boldsymbol{x}$ 和 $\boldsymbol{y}$ 之间的夹角 $\theta(\boldsymbol{x}, \boldsymbol{y})$ 定义为:

定义16 (向量与子空间的夹角):向量 $x$ 与子空间 $\mathcal{S}$ 之间的锐角定义为 $x$ 与子空间 $\mathcal{S}$ 中的所有向量 $y$ 之间的最小锐角,即:

定义17(两个子空间的夹角):子空间 $\mathcal{H}$ 和 $\mathcal{S}$ 之间的夹角定义为 $\mathcal{H}$ 中的向量 $x$ 与 $\mathcal{S}$ 之间的最小锐角:

定理5:正交投影。令 $P$ 是到子空间 $\mathcal{S}$ 的正交投影算子,则对于任意 $x \in \mathbb{C}^n$,有:

或等价为:

证明略。

子空间旋转

问题:给定 $m \times n$ 数据矩阵 $\boldsymbol{A}$ 和 $\boldsymbol{B}$ 。希望求一个 $n \times n$ 实 正交矩阵 $Q$,在 $Q^{\mathrm{T}} Q=I$ 的约束条件下,使得:

即通过正交矩阵 $Q$, 强迫 $B Q$ 与 $A$ 尽可能一致。

一方面,由于 $Q$ 正交,矩阵乘积 $B Q$ 并不改变 $\boldsymbol{B}$ 的列向量之间的线性相关性,即 $\operatorname{Col}(\boldsymbol{B Q})=$ $\operatorname{Col}(\boldsymbol{B})$;另一方面,矩阵乘积 $B Q$ 相当于使 $\boldsymbol{B}$ 的列张成的空间旋转。因此,从子空间的角度看,正交强迫一致问题相当于使 $\operatorname{Col}(\boldsymbol{B})$ 旋转以尽量接近$\operatorname{Col}(\boldsymbol{A})$ 。接近程度由误差矩阵的 $|\cdot|_{\mathrm{F}}$ 来衡量。

实现:为使 $|A-B Q|_{\mathrm{F}}^2$ 最小化,应该选择正交矩阵 $Q$ 使得 $B Q$ 具有与 $A$ 完全相同的非对角元素,并且对角元素的平方和尽可能接近。由于:

于是,正交强迫一致问题等价于使矩阵的迹 $\operatorname{tr}\left(\boldsymbol{Q}^{\mathrm{T}} \boldsymbol{B}^{\mathrm{T}} \boldsymbol{A}\right)$ 最大化。而 $\operatorname{tr}\left(\boldsymbol{Q}^{\mathrm{T}} \boldsymbol{B}^{\mathrm{T}} \boldsymbol{A}\right)$ 的最大化可以通过矩阵乘积 $\boldsymbol{B}^{\mathrm{T}} \boldsymbol{A}$ 的奇异值分解 $\boldsymbol{B}^{\mathrm{T}} \boldsymbol{A}=\boldsymbol{U} \boldsymbol{\Sigma} \boldsymbol{V}^{\mathrm{T}}$ 来实现。若定义正交矩阵 $\boldsymbol{Z}=\boldsymbol{V}^{\mathrm{T}} \boldsymbol{Q}^{\mathrm{T}} \boldsymbol{U}$,则有:

当且仅当 $\boldsymbol{Z}=\boldsymbol{I}$ 即 $\boldsymbol{Q}=\boldsymbol{U} \boldsymbol{V}^{\mathrm{T}}$ 时,等号成立。

换言之,$\boldsymbol{Q}=\boldsymbol{U} \boldsymbol{V}^{\mathrm{T}}$ 最大化 $\operatorname{tr}\left(\boldsymbol{Q}^{\mathrm{T}} \boldsymbol{B}^{\mathrm{T}} \boldsymbol{A}\right)$,从而最小化 $|\boldsymbol{A}-\boldsymbol{B Q}|_{\mathrm{F}}$,即为正交强迫一致问题的解。

注:若 $\boldsymbol{B}=\boldsymbol{I}$,则正交强迫一致问题变为:

即求与给定 $n \times n$ 矩阵 $\boldsymbol{A}$ 最接近的正交矩阵。根据前面分析可知,若 $A=U \Sigma V^{\mathrm{T}}$ 是 $A$ 的奇异值分解,则 $Q=$ $U V^{\mathrm{T}}$ 即为与矩阵 $A$ 最接近的正交矩阵。

行列空间

矩阵 $\boldsymbol{A}=\left[\boldsymbol{a}_1, \boldsymbol{a}_2, \cdots, \boldsymbol{a}_n\right] \in \mathbb{C}^{m \times n}$ 的列空间 (column space)或列张成(column span)定义为列向量的所有线性组合的集合:

矩阵 $A$ 的的行空间 (row space) 或行张成 (row span)定义为其复共轭行向量 $\boldsymbol{r}_1^*, \cdots, \boldsymbol{r}_m^* \in \mathbb{C}^n$ 的所有线性组合的集合:

行列空间的各种定义:

(1)矩阵 $\boldsymbol{A} \in \mathbb{C}^{m \times n}$ 的值域 (range)

(2)矩阵 $A$ 的零空间 (null space)或核 (kernel)

(3)复矩阵 $\boldsymbol{A}_{m \times n}$ 的共轭转置 $\boldsymbol{A}^{\mathrm{H}}$ 的零空间定义为:

(4)零空间的维数称为 $A$ 的零化维或零度 (nullity):

定理:若 $\boldsymbol{A} \in \mathbb{C}^{m \times n}$,则 $\boldsymbol{A}$ 的行空间的正交补 $(\operatorname{Row}(\boldsymbol{A}))^{\perp}$ 是 $\boldsymbol{A}$ 的零空间,并且 $\boldsymbol{A}$ 的列空间的正交补 $(\operatorname{Col}(\boldsymbol{A}))^{\perp}$ 是 $\boldsymbol{A}^{\mathrm{H}}$ 的零空间,即有:

证明略。

其他两个性质:

(1)矩阵 $A$ 的值域与其列空间相等,即:

(2) 矩阵 $A$ 的行空间与 $A^{\mathrm{H}}$ 的列空间相等,即:

定理:矩阵 $\boldsymbol{A} \in \mathbb{C}^{m \times n}$ 的列空间与行空间的维数相等,即为其秩 $\operatorname{rank}(\boldsymbol{A})$,且有:

子空间基的计算

初等变换法

思想:矩阵的初等变换不会改变其行空间、列空间与零空间。

奇异值分解

令秩 $\operatorname{rank}(\boldsymbol{A})=r$ 的矩阵 $\boldsymbol{A} \in \mathbb{C}^{m \times n}$ 具有奇异值分解:

则有:

(1)与非零奇异值对应的 $r$ 个左奇异向量 $\boldsymbol{u}_1, \cdots, \boldsymbol{u}_r$ 是列空间 $\operatorname{Col}(\boldsymbol{A})$ 的一个标准正交基,即有:

(2)与非零奇异值对应的 $r$ 个右奇异向量 $\boldsymbol{v}_1, \cdots, \boldsymbol{v}_r$ 是行空间 $\operatorname{Row}(\boldsymbol{A})$ 的一个标准正交基,即:

(3)与零奇异值对应的 $(m-r)$ 个左奇异向量 $\boldsymbol{u}_{r+1}, \cdots, \boldsymbol{u}_m$ 是零空间 $\operatorname{Null}\left(\boldsymbol{A}^{\mathrm{H}}\right)$ 的一个标准正交基。

(4)与零奇异值对应的 $n-r$ 个右奇异向量 $\boldsymbol{v}_{r+1}, \cdots, \boldsymbol{v}_n$ 是零空间 $\operatorname{Null}(\boldsymbol{A})$ 的一个标准正交基。

如何求两个零空间交的标准正交基?给定两个矩阵 $\boldsymbol{A} \in \mathbb{C}^{m \times n}$ 和 $\boldsymbol{B} \in \mathbb{C}^{p \times n}$,如何构造零空间的交 $\operatorname{Null}(\boldsymbol{A}) \cap \operatorname{Null}(\boldsymbol{B})$ 的标准正交基?

(1)平凡方法

即 $C$ 的零空间等于 $A$ 的零空间和 $B$ 的零空间的交:$\operatorname{Null}(\boldsymbol{C})=\operatorname{Null}(\boldsymbol{A}) \cap \operatorname{Null}(\boldsymbol{B})$ 。

这种方法涉及 $(m+p) \times n$ 矩阵 $\boldsymbol{C}$ 的奇异值分解。

(2)奇异值分解法

a) 计算矩阵 $\boldsymbol{A}$ 的奇异值分解 $\boldsymbol{A}=\boldsymbol{U}A \boldsymbol{\Sigma}_A \boldsymbol{V}_A^{\mathrm{H}}$, 判断其有效秩 $r$,进而得到零空间 $\operatorname{Null}(\boldsymbol{A})$ 的正交基 $\left{\boldsymbol{v}{r+1}, \cdots, \boldsymbol{v}n\right}$,并令 $\boldsymbol{Z}=\left[\boldsymbol{v}{r+1}, \cdots, \boldsymbol{v}_n\right]$ 。

b) 计算矩阵 $C{p \times(n-r)}=B Z$ 的奇异值分解 $\boldsymbol{C}=$ $\boldsymbol{U}_C \boldsymbol{\Sigma}_C \boldsymbol{V}_C^{\mathrm{H}}$,判断其有效秩 $q$,进而得到零空间 $\operatorname{Null}(\boldsymbol{B} \boldsymbol{Z})$ 的正交基 $\left{\boldsymbol{w}{q+1}, \cdots, \boldsymbol{w}{n-r}\right}$,并令 $\boldsymbol{W}=$ $\left[\boldsymbol{w}{q+1}, \cdots, \boldsymbol{w}{n-r}\right]。$

c) 计算矩阵 $Z W$,则其列向量即为零空间的交 $\operatorname{Null}(\boldsymbol{A}) \cap \operatorname{Null}(\boldsymbol{B})$ 的一组正交基。

信号子空间与噪声子空间

观测信号模型:

式中,有:

(1)$\boldsymbol{s}(t)=\left[s_1(t), s_2(t), \cdots, s_r(t)\right]^{\mathrm{T}}$ : 随机信号向量

(2)$\boldsymbol{A}=\left[\boldsymbol{a}\left(\omega_1\right), \cdots, \boldsymbol{a}\left(\omega_r\right)\right]: n \times r$ 信号混合矩阵 (满列秩)

(3)$\boldsymbol{a}\left(\omegai\right)=\left[a{1, i}\left(\omegai\right), a{2, i}\left(\omegai\right), \cdots, a{n, i}\left(\omega_i\right),\right]^{\mathrm{T}}:$ 对信号 $s_i$ 的响应向量

(4)$\boldsymbol{w}(t)=\left[w_1(t), w_2(t), \cdots, w_n(t)\right]^{\mathrm{T}}$ : 加性噪声向量

问题:如何根据 $N$ 个快拍的观测数据矢量 $\boldsymbol{x}(1), \cdots, \boldsymbol{x}(N)$ 估计 $r$ 个信号参数 $\omega_i$?

假定噪声向量 $\boldsymbol{w}(t)=\left[w_1(t), w_2(t), \cdots, w_n(t)\right]^{\mathrm{T}}$ 的各分 量统计不相关且具有相同方差 (功率) $\sigma_w^2$, 即有 $\boldsymbol{R}_w=$ $\mathrm{E}\left{\boldsymbol{w} \boldsymbol{w}^{\mathrm{H}}\right}=\sigma_w^2 \boldsymbol{I}$, 同时信号与噪声不相关,则可得:

其中 $\boldsymbol{R}_s=\mathrm{E}\left{\boldsymbol{s s}^{\mathrm{H}}\right}$ 为信号相关矩阵,其对角线元素为各信号功率。如果各信号分量 $s_i(t)$ 也统计不相关,则有 $\operatorname{rank}\left(\boldsymbol{R}_s\right)=r$。令 $\boldsymbol{A} \boldsymbol{R}_s \boldsymbol{A}^{\mathrm{H}}$ 的特征值分解为:

其中对角矩阵 $\boldsymbol{\Sigma}$ 包含 $r$ 个非零特征值 $\sigma_1^2, \cdots, \sigma_r^2$ 和 $n-r$ 个零特征值,则根据 $\boldsymbol{R}_x$ 的结构可知:

即 $\boldsymbol{U}$ 同时为 $\boldsymbol{R}_x$ 的特征矢量矩阵。

由上可见,$\boldsymbol{R}_x$ 的特征值为:

如果信噪比 (SNR) 足够大,即 $\sigma_r^2$ 比 $\sigma_w^2$ 明显大,则将含噪声的自相关矩阵 $\boldsymbol{R}_x$ 的前 $r$ 个 “大” 特征值:

称为主特征值 (principal eigenvalue),而将剩余的 $n-r$ 个 “小” 特征值:

称为次特征值 (minor eigenvalue)。

相应地,可以对特征矢量矩阵 $\boldsymbol{U}$ 进行列划分 $\boldsymbol{U}=$ $\left[\boldsymbol{u}1, \cdots, \boldsymbol{u}_r \mid \boldsymbol{u}{r+1}, \cdots, \boldsymbol{u}_n\right]=[\boldsymbol{S}, \boldsymbol{G}]$, 其中 $\boldsymbol{S}^{\mathrm{H}} \boldsymbol{G}=\boldsymbol{O}$ 。

根据 $\boldsymbol{U}=[\boldsymbol{S}, \boldsymbol{G}]$,我们有:数据空间(观测空间)=信号子空间+噪声子空间

信号子空间: $\operatorname{Span}(\boldsymbol{S})=\operatorname{Span}\left{\boldsymbol{u}_1, \cdots, \boldsymbol{u}_r\right}$

噪声子空间: $\operatorname{Span}(\boldsymbol{G})=\operatorname{Span}\left{\boldsymbol{u}_{r+1}, \cdots, \boldsymbol{u}_n\right}$

信号子空间与噪声子空间的性质

(1) 信号子空间与噪声子空间相互正交,即 $\operatorname{Span}(\boldsymbol{S}) \perp$ $\operatorname{Span}(\boldsymbol{G})$ 或 $\boldsymbol{S}^{\mathrm{H}} \boldsymbol{G}=\boldsymbol{G}^{\mathrm{H}} \boldsymbol{S}=\boldsymbol{O}$

(2) 由于 $\boldsymbol{U}$ 是酉矩阵,因此

即有:

(3) 定义到信号子空间上的投影矩阵:

于是,$\boldsymbol{P}_s \boldsymbol{x}$ 代表将数据向量 $\boldsymbol{x}$ 往信号子空间上投影(抑制噪声 ) 。同样,可定义到噪声子空间的投影矩阵:

MUSIC算法

MUSIC (Multiple Signal Classification)算法,即多信号分类算法。 MUSIC 算法是一种基于子空间分解的算法,它利用信号子空间和噪声子空间的正交性,构建空间谱函数,通过谱峰搜索,估计信号的参数。对于声源定位来说,需要估计信号的 DOA (信号的到达方向,即信号从哪个方向传输到接收器。)。 MUSIC 算法对 DOA 的估计有很高的分辨率,且对麦克风阵列的形状没有特殊要求,因此应用十分广泛。

考虑 $r$ 个信号照射在 $n$ 阵元的多天线等距线阵模型:

式中:

(1)$\boldsymbol{s}(t)=\left[s_1(t), s_2(t), \cdots, s_r(t)\right]^{\mathrm{T}}$ : 随机信号向量

(2)$\boldsymbol{A}=\left[\boldsymbol{a}\left(\omega_1\right), \cdots, \boldsymbol{a}\left(\omega_r\right)\right]: n \times r$ 阵列响应矩阵 (满列秩)

(3)$\omega_i=2 \pi \frac{d}{\lambda} \sin \theta_i:$ 与 $s_i(t)$ 的方向角 $\theta_i$ 有关的空间参数

(4)$\boldsymbol{w}(t)=\left[w_1(t), w_2(t), \cdots, w_n(t)\right]^{\mathrm{T}}:$ 加性噪声向量

问题:根据 $N$ 个快拍数据矢量 $\boldsymbol{x}(1), \cdots, \boldsymbol{x}(N)$ 估计 $r$ 个信号的波达方向角 $\theta_i$,从而进行信号 (目标) 分类。

观测数据 $\boldsymbol{x}(1), \cdots, \boldsymbol{x}(N)$ 可以估计其协方差矩阵 $\boldsymbol{R}_x$,并进行特征值分解:

式中, $\Sigma$ 包含了 $r$ 个大特征值。考查:

又由 $\boldsymbol{R}_x=\boldsymbol{A} \boldsymbol{R}_s \boldsymbol{A}^{\mathrm{H}}+\sigma_w^2 \boldsymbol{I}$ 有 $\boldsymbol{R}_x \boldsymbol{G}=\boldsymbol{A} \boldsymbol{R}_s \boldsymbol{A}^{\mathrm{H}} \boldsymbol{G}+\sigma_w^2 \boldsymbol{G}$,有:

由于 $\boldsymbol{R}_s$ 半正定,上式成立当且仅当 $A^{\mathrm{H}} G=O$, 即 $\boldsymbol{a}^{\mathrm{H}}\left(\omega_i\right) \boldsymbol{G}=\mathbf{0}^{\mathrm{T}}, i=1, \cdots, r$。而 $\omega \neq \omega_i$ 时,$\boldsymbol{a}^{\mathrm{H}}(\omega) \boldsymbol{G} \neq \mathbf{0}^{\mathrm{T}}$。

据此,将 $\boldsymbol{a}^{\mathrm{H}}(\omega) \boldsymbol{G} \neq \mathbf{0}^{\mathrm{T}}$ 改写成标量形式,从而可以定义一种类似于功率谱的函数:

当 $\omega=\omega_1, \omega_2, \cdots, \omega_r$ 时,上式将出现峰值。因此,根据 $P(\omega)$ 的峰值点,可以确定 $r$ 个信号的波达方向 $\theta_1, \theta_2, \cdots, \theta_p$ 。 由于 $P(\omega)$ 描述了信号空间参数 (即波达方向) 的分布,故称为空间谱。又由于它能对多个空间信号进行识别 (分类),故这种方法称为多重信号分类算法。(MUSIC)

0x10 投影分析

矩阵分析:从一个点(向量)到一子空间的最短 距离是与该子空间正交的距离。如果 $\boldsymbol{x} \in H$, 而 $M$ 是向量空间 $H$ 的一个子空间, 并且 $x$ 不在 子空间 $M$ 内, 那么最短距离问题就是求使得范 数 $|x-\hat{x}|$ 最小的向量 $\hat{x} \in M$ 。

投影:若有

则 $\hat{\boldsymbol{x}}$ 称为向量 $\boldsymbol{x}$ 在子空间 $M$ 上的投影。

投影定理:令 $H$ 是向量空间, 而 $M$ 是 $H$ 内 的 $n$ 维子空间。若对于 $H$ 中的向量 $\boldsymbol{x}$,在子空间 $M$ 内有一个向量 $\hat{\boldsymbol{x}}$, 使得 $\boldsymbol{x}-\hat{\boldsymbol{x}}$ 与 $M$ 中的每一个向量 $\boldsymbol{y}$ 都满足正交条件,即:

则不等式 $|\boldsymbol{x}-\hat{\boldsymbol{x}}| \leqslant|\boldsymbol{x}-\boldsymbol{y}|$ 对于所有向量 $\boldsymbol{y} \in$ $M$ 成立,并且等号仅当 $\boldsymbol{y}=\hat{\boldsymbol{x}}$ 时成立。

正交投影:向量 $\boldsymbol{x}$ 到子空间 $M$ 的正交补 $M^{\perp}$ 上 的投影则称为正交投影,记为 $\boldsymbol{P}_M^{\perp} \boldsymbol{x}$

到子空间 $M=\operatorname{Span}(\boldsymbol{M})$ 的投影矩阵: $\boldsymbol{P}_M$

到子空间 $M=\operatorname{Span}(\boldsymbol{M})$ 的正交投影矩阵: $\quad \boldsymbol{P}_M^{\perp}$ 投影矩阵与正交投影矩阵的关系

表明投影矩阵 $\boldsymbol{P}_M$ 和正交投影矩阵 $\boldsymbol{P}_M^{\perp}$ 不可能非 奇异,一定均是奇异矩阵。

投影的性质:

(1)线性: $\boldsymbol{P}M(\alpha \boldsymbol{x}+\beta \boldsymbol{y})=\alpha \boldsymbol{P}_M \boldsymbol{x}+\beta \boldsymbol{P}_M \boldsymbol{y}$, $\boldsymbol{x}, \boldsymbol{y} \in H ; \alpha, \beta \in C{\circ}$

(2)三角恒等式:$|\boldsymbol{x}|^2=\left|\boldsymbol{P}_M \boldsymbol{x}\right|^2+|(\boldsymbol{I}-$ $\left.\boldsymbol{P}_M\right) \boldsymbol{x} |^2$

(3)分解的唯一性:每一个 $x \in M$ 都具有以下的唯一表示:

即 $\boldsymbol{x}$ 可以唯一分解成 $M$ 的元素与 $M^{\perp}$ 的元素之和。

(4)收敛性: $\boldsymbol{P}_M \boldsymbol{x}_n \rightarrow \boldsymbol{P}_M \boldsymbol{x}$, 若 $\left|\boldsymbol{x}_n-\boldsymbol{x}\right| \rightarrow $ 0。

(5)内含性: $\boldsymbol{x} \in M$ 当且仅当 $\boldsymbol{P}_M \boldsymbol{x}=\boldsymbol{x}$ 。

(6)垂直性: $\boldsymbol{x} \in M^{\perp}$ 当且仅当 $\boldsymbol{P}_M \boldsymbol{x}=\mathbf{0}$ 。

(7)子空间隶属性: $M1 \subseteq M_2$, 当且仅 当 $\boldsymbol{P}{M1} \boldsymbol{P}{M2} \boldsymbol{x}=\boldsymbol{P}{M_1} \boldsymbol{x}$ 对所有 $\boldsymbol{x} \in H$ 恒成立。

四种矩阵:

(1)幂等矩阵(idempotent matrix):满足幂等关系 $A^2=A$ 的矩阵 $A$ 称为幂等矩阵

(2)幂零矩阵(nilpotent matrix):满足 $\boldsymbol{A}^2=\boldsymbol{O}$ (零矩阵) 的矩阵 $A$ 称为幂零矩阵

(3)幂1矩阵(unipotent matrix):满足 $A^2=\boldsymbol{I}$ (单位矩阵) 的矩阵 $\boldsymbol{A}$ 称为幂 1 矩阵

(4)三幂矩阵 (tripotent matrix):矩阵 $\boldsymbol{A}_{n \times n}$ 称为三幂矩阵,若 $A^3=\boldsymbol{A}$

幂等矩阵性质:

(1)幂等矩阵的特征值只取 1 和 0 两个数值。

(2)所有的幂等矩阵(单位矩阵除外) $\boldsymbol{A}$ 都是奇异矩阵。

(3)所有幂等矩阵的秩与迹相等,即 $\operatorname{rank}(\boldsymbol{A})=$ $\operatorname{tr}(\boldsymbol{A})$ 。

(4) 若 $A$ 为幂等矩阵,则 $A^{\mathrm{H}}$ 也为幂等矩阵,即有 $\boldsymbol{A}^{\mathrm{H}} \boldsymbol{A}^{\mathrm{H}}=\boldsymbol{A}^{\mathrm{H}}$ 。

(5) 若 $\boldsymbol{A}$ 为幂等矩阵,则 $\boldsymbol{I}_n-\boldsymbol{A}$ 也是幂等矩阵,且 $\operatorname{rank}\left(\boldsymbol{I}_n-\boldsymbol{A}\right)=n-\operatorname{rank}(\boldsymbol{A})$ 。

(6)所有对称的幂等矩阵 (单位矩阵除外) 都是半正定的。

(7) 令 $n \times n$ 幂等矩阵 $\boldsymbol{A}$ 的秩为 $r_A$,则 $\boldsymbol{A}$ 有 $r_A$ 个特 征值 1 和 $n-r_A$ 个特征值 0 。

(8) 所有的幂等矩阵 $A$ 都是可对角化的:

式中,$r_A=\operatorname{rank}(\boldsymbol{A})$ 。

幂等矩阵与三幂矩阵:

由于 $A^3=A$ 为三幂矩阵,因此 $\boldsymbol{A u}=$ $\lambda^3 \boldsymbol{u}$,故三幂矩阵的特征值满足关系式 $\lambda=\lambda^3$,即三幂矩阵的特征值有 $-1,0,+1$ 三种取值的可能,这与幂等矩阵的特征值只取 0 和 +1 两种值不同。

投影算子:考虑向量空间 $C^n=S \oplus H$ 内的任意向量 $\boldsymbol{x} \in C^n$ 。若 $\boldsymbol{x}=\boldsymbol{x}1+\boldsymbol{x}_2$ 满足 $\boldsymbol{x}_1 \in$ $S$ 和 $\boldsymbol{x}_2 \in H$,并且 $\boldsymbol{x}_1$ 和 $\boldsymbol{x}_2$ 是唯一确定的,则称映射 $\boldsymbol{P} \boldsymbol{x}=\boldsymbol{x}_1$ 是向量 $\boldsymbol{x}$ 沿着子空间 $H$ 的方向,到子空间 $S$ 的投影,并称 $P$ 是沿着 $H$ 的方向,到 $S$ 的投影算子(projector onto $S$ along $H$ ),常简记为 $\boldsymbol{P}{S \mid H^{\circ}}$

复向量 $\boldsymbol{x} \in C^n$ 都可以唯一分解为:

正交分解: 任意一个满足 $\boldsymbol{x}_1 \perp \boldsymbol{x}_2$ 的向量分解 $x=x_1+x_2$ 称为正交分解。

正交投影算子:若 $P$ 为投影算子,并且 $\boldsymbol{P} \perp$ $(I-P)$,则称 $P$ 为正交投影算子(orthogonal projector)。显然,沿着正交补 $S^{\perp}$ 的方向,到子空间 $S$ 的投影算子 $\boldsymbol{P}_{S \mid S^{+}}$为正交投影算子。

斜投影算子:若 $P$ 为投影算子,但不满足 $P \perp$ $(\boldsymbol{I}-\boldsymbol{P})$,则称 $P$ 为斜投影算子。斜投影算子是非正交投影算子的统称。

定理 1:线性齐次算子 $\boldsymbol{P}$ 是投影算子,当且仅当 $\boldsymbol{P}$ 是幂等矩阵,即:

定理2:齐次线性算子 $\boldsymbol{P}$ 是正交投影算子,当且仅当下列两个条件都满足:

(1)线性算子是幂等算子,即 $\boldsymbol{P}^2=\boldsymbol{P}_{\text {。 }}$ 。

(2)线性算子具有Hermitian性(复共轭对称性),即 $\boldsymbol{P}^{\mathrm{H}}=\boldsymbol{P}$ 。

投影矩阵的本质作用

令 $m \times m$ 投影矩阵 $\boldsymbol{P}$ 有 $r$ 个特征值为 1,另外 $m-$ $r$ 个特征值为 0 。于是,投影矩阵可以写作:

考查任意一个 $m \times 1$ 向量 $\boldsymbol{x}$ 的投影 $\boldsymbol{y}=\boldsymbol{P} \boldsymbol{x}$,则:

上式揭示了投影矩阵的本质作用:

(1)向量 $x$ 经过投影矩阵 $\boldsymbol{P}$ 投影后,向量 $x$ 与投 影矩阵中具有特征值1的特征向量相关的部分 $\boldsymbol{x}^{\mathrm{H}} \boldsymbol{u}_i(i=1,2, \cdots, r)$ 在投影结果 $\boldsymbol{P} \boldsymbol{x}$ 中被完整保留。

(2)向量 $\boldsymbol{x}$ 与投影矩阵中具有特征值 0 的特征向量相关的部分 $\boldsymbol{x}^{\mathrm{H}} \boldsymbol{u}_i(i=r+1, r+2, \cdots, m)$ 被投影矩阵全部对消,不出现在投影结果 $\boldsymbol{P} \boldsymbol{x}$ 中。

本质作用:抽取信号,抑制干扰和噪声

条件:SINR足够大,使得主和次特征值区分明显

补充

交换矩阵是一个方阵,其所有对角线上的元素都是1,而所有非对角线上的元素都是相同的负数。

$ (A \otimes B)^T = A^T \otimes B^T$

$(AB)^T=B^TA^T$

留言

- 文章链接: https://wd-2711.tech/

- 版权声明: 本博客所有文章除特别声明外,均采用 CC BY-NC-ND 4.0 许可协议。转载请注明出处!